这一系列博客文章源自2020年10月在GameSoundCon上发表的演讲。演讲目的是为创作者提供通过使用基于对象的音频渲染技术来完善他们新项目的视角和工具。而该技术能够实现尽可能自然的空间音频体验。

此内容分为三部分:

-

本文内容即第一部分,通过展示该技术如何在多系统和播放终端上实现更好的表现,让音频从业者了解使用基于对象的音频(相对于基于通道的音频)来创作新项目时的优势。

-

第二部分阐述Wwise 2021.1如何通过充分利用音频对象,为所有混音工作考量丰富强化工作流,从而进化为一个更加全面的创作环境的。

-

最后,第三部分将分享一系列由声音设计师和作曲家在近期项目中应用音频对象时所采用的方法、技巧。

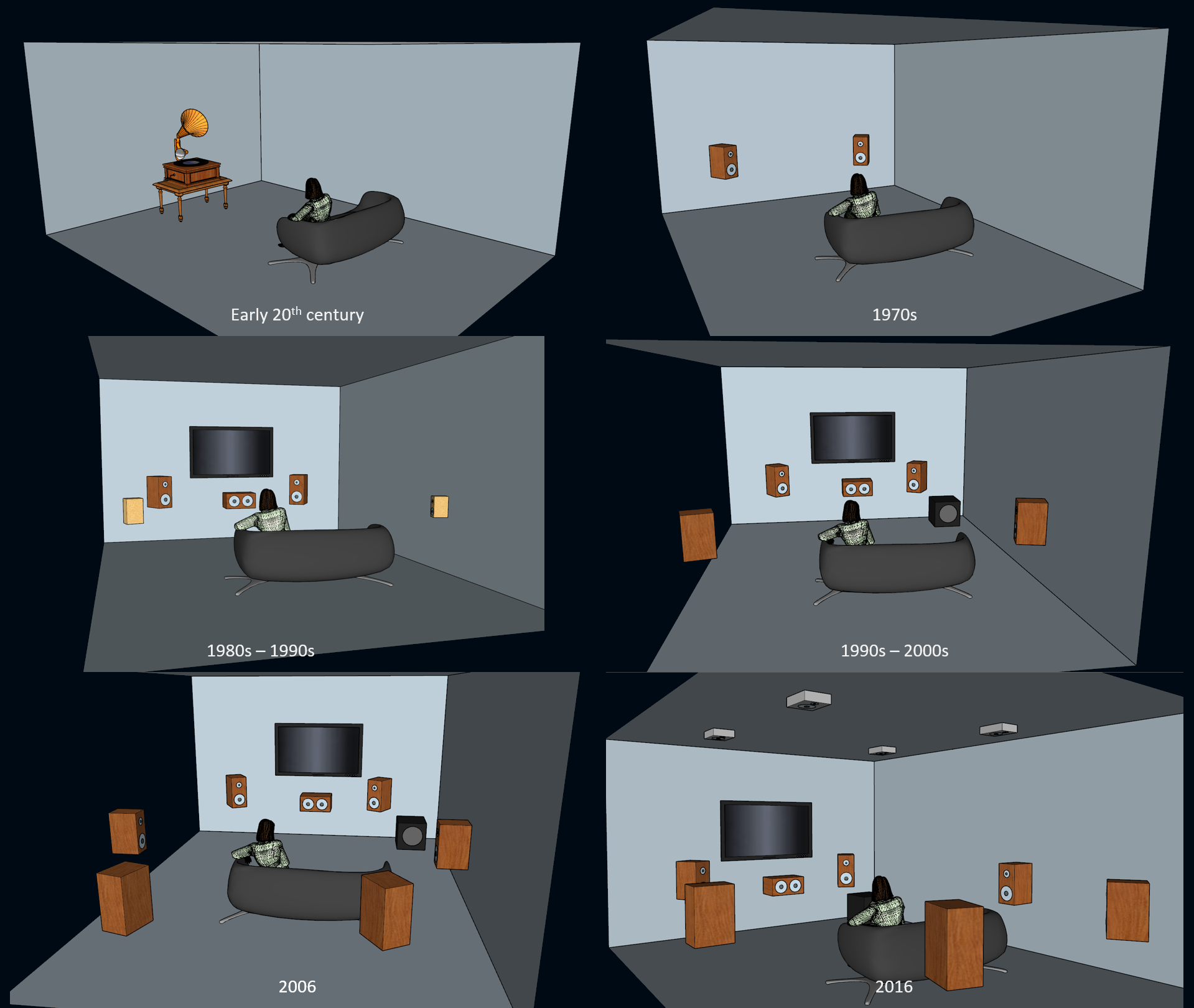

空间信息编码 - 历史综述

为记录声音而编码音频的做法已有百余年历史。几十年来,编码方式基于单声道制式,而单声道的设计并不能很好的提供空间信息(虽然有些人认为单声道录音可以很容易地记录声音的深度,这也是空间的一个维度)。而直到20世纪70年代,随着立体声系统的大量应用,公众逐渐开始接触到有更多空间信息的音乐录音产品。而随着人们对立体声格式的普遍接受,关于空间音频、空间定位的探索与讨论,在音频工程师和音乐爱好者们的圈子里变得越来越热。

后来,20世纪80年代,随着VCRs(盒式录像机)的推广和VHS(家庭影像系统)影片租赁的流行,业界提出了打造家庭影院式体验的构想…而对于普通大众来说,想要实现这个构想,首先你需要拥有一套全新的音响系统!这就是行业如何从LCRS(左-中-右-环绕声)发展到全动态频响范围的5.1扬声器配置,7.1,再到如今加上了高度通道的7.1.4。

空间音频消费场景演变

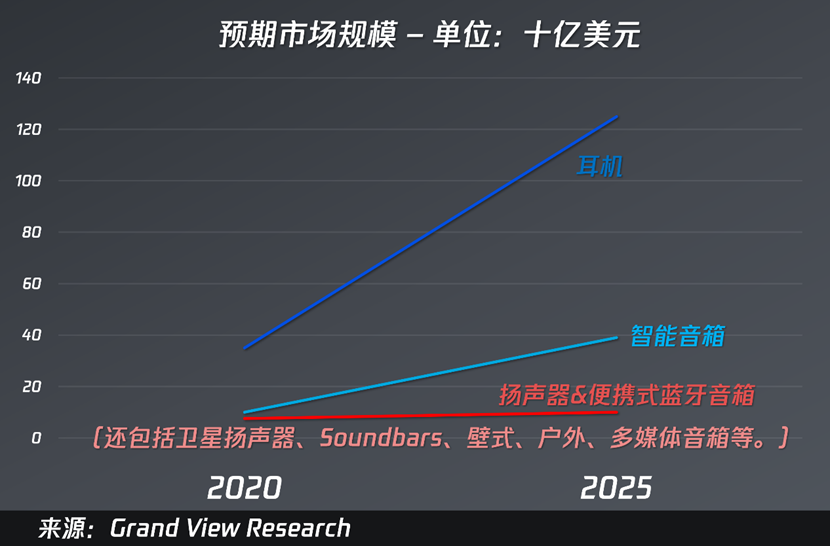

而在过去的十年里,人们的生活方式开始向移动端倾斜,客厅里音箱的使用场景逐渐被耳机所代替。手机和在线游戏的普及无疑加速了这种转变。而从音箱与耳机的销售趋势及预期市场规模来看,强烈迹象表明,未来耳机仍将是大势所趋。

未来五年的预期销售及增长,耳机将占据市场主导地位

感知空间音频

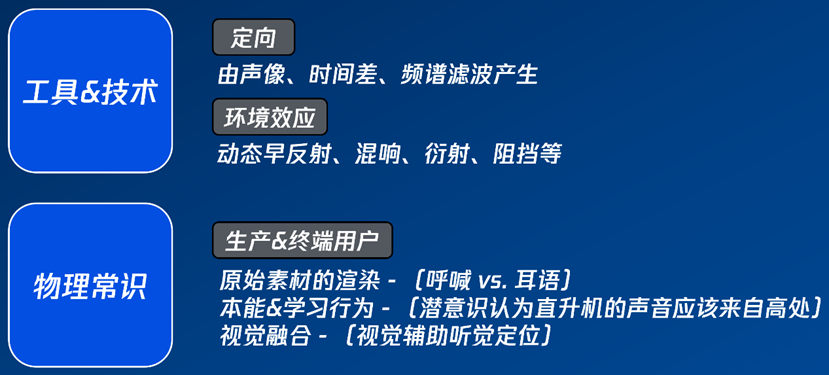

要通过音箱或耳机实现逼真的空间音频体验,有两个互补的必要因素:

-

工具与技术:音频技术应尽可能精确地模拟声音的物理特性。

-

物理常识:表现应该符合我们的日常生活经验。

让我们更详细地看看这两个因素。

技术和物理常识是帮助我们感知空间音频的两大因素

定向的实现

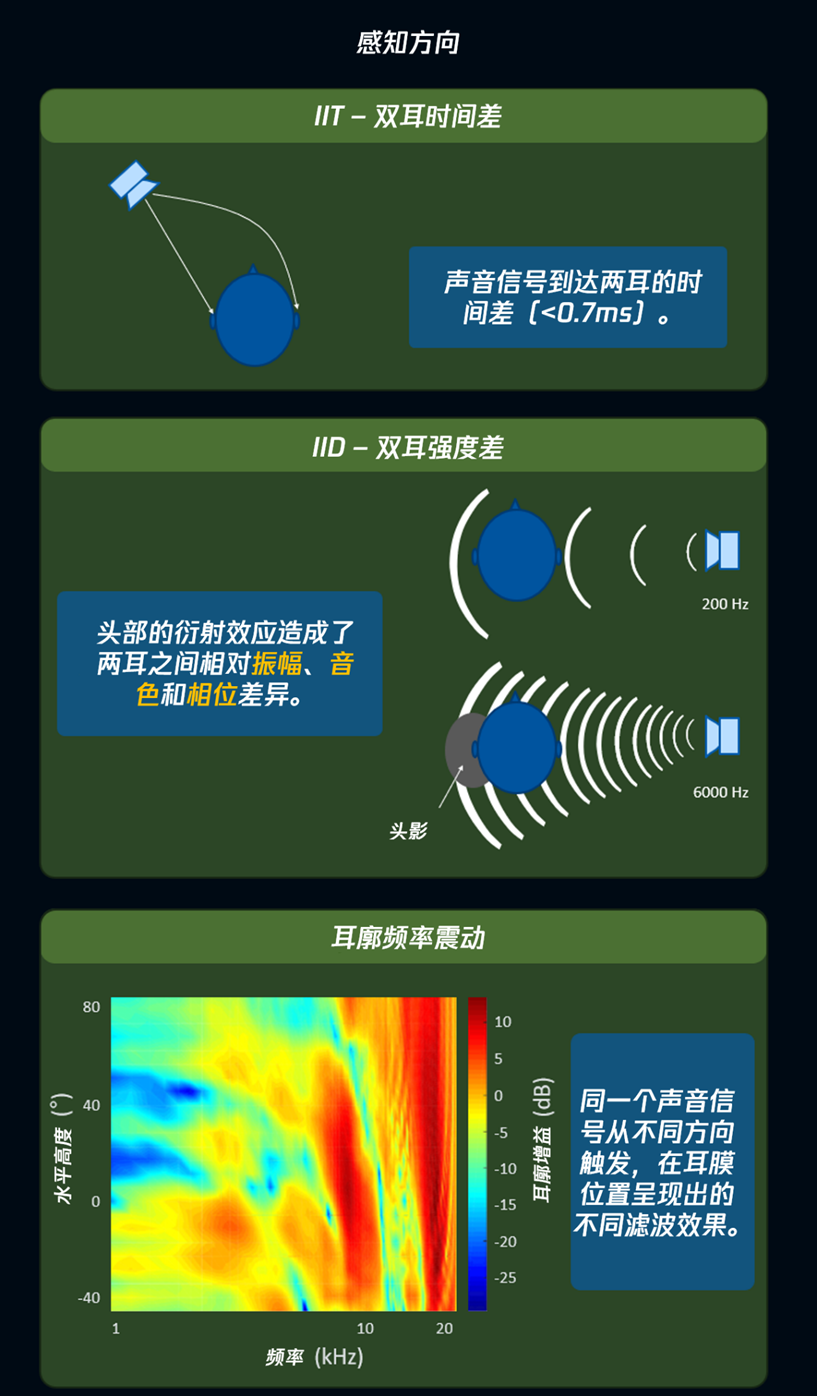

目前来说HRTF(头部相关传输函数)是在耳机端实现高精度声音定向的最佳技术。为了准确实现声音定向,HRTF算法利用了以下原理:

-

ITD(双耳时间差):表示两耳之间同个声音信号到达的时间差异。其量级甚至不到一毫秒,但足以让大脑获取方向信息。

-

IID(双耳强度差):表示声音信号传播时头部对其中一只耳朵的阻挡作用造成的两耳之间相对振幅、音色和相位差异。这种效应一定程度上与声音信号自身频率有关。

-

耳廓频率震动:表示同一声音从不同方向传来时耳膜处呈现的不同滤波效果。

利用ITD、IID和耳廓频率震动技术来提高听者周围空间音频的准确性。本文很好地说明了HRTF的原理

环境效应的实现

通过技术可以模拟的另一个方面则是各类环境效应,如距离衰减、动态早反射、混响、衍射和阻挡等。充分利用以上元素,丰富的环境信息可让大脑感知到更加逼真的空间音频。请注意,利用环境效应模拟真实空间这个话题能展开聊很多,但本文关注的主要方面在使用音频对象的优势所以暂不讨论。

物理常识因素

另一个会影响空间音频感知的因素则不再关乎技术,而依赖于我们生活中的三类常识。

第一个方面与“音色常识”有关:如果你听到有人在说悄悄话,那他很可能就在附近,会比听到同样的内容在大声喊要近得多。

第二个方面关于“本能和学习行为”,作为人类,当感知到某些事物时我们会本能地期望得到经验中的声音反馈,比如当飞机从我们头顶飞过时。这是随着时间推移我们在成长过程中习得的东西。

最后一个方面关于“视觉融合”,即我们的眼睛会协助耳朵在3D空间中精确定位发声位置。例如,当你听到视野之外的声音时,你能猜到它的大致方位,但只有移动头部配合视觉观察,你才能定位到发声体的准确位置。

Brian Schmidt在2017年MIGS上发表的演讲“技术对创造力的影响,案例研究:超越HRTF”中详细阐述了物理常识是如何影响我们感知空间音频的能力的。

基于通道的音频

上半部分讲了我们如何感知空间音频,以及涉及的一些相关技术,那么让我们再来回顾一下,使用基于通道的方式在各类媒体上实现声音定向、模拟环境效应时情况又是怎样的,如黑胶唱片、磁带、数字媒体以及各类实时应用,比如Wwise。

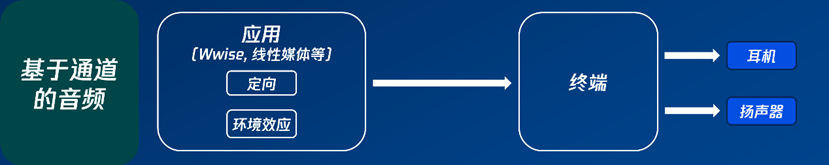

基于通道的方式,声音定向及环境效应在应用程序端实现

考虑到当时的技术和算力,依靠基于通道的方式来编码空间信息是一种有效的解决方案。然而,当要实现更精准的空间定位时,基于通道的很多短板就暴露出来了。典型问题如通道摆位的角度不均造成的声像失真和声音卡顿感,快速移动声音的相位问题,以及只能在平面或半球体空间内定位声音等。这还不包括一些消费者使用层面的现实,像音箱配置问题、摆位问题、接线问题等等。

值得注意的是,对于Ambisonics来说,尽管技术上它也是基于通道的一种格式,却并不会遇到上述问题。Ambisonics技术利用通道将声场编码成了球体的形式,通道越多,声场定位越精准。关于Ambisonics推荐以下文章:Ambisonics格式概述, Ambisonics空间应用。

终端是什么?

我们用术语endpoint代指负责对发送到耳机或扬声器的音频信号做最终处理和混音的系统设备(例如,各平台操作系统中负责音频处理的模块)。

在游戏初始化时,Wwise会收到终端的音频配置(如2.0、5.1、耳机的Windows Sonic以及PS5的3D音频等),因此Wwise会以终端需要的格式来渲染音频。

音频对象的出现

多年来,线性或非线性音频混音工作的顶级标准一直是在一个相对受控的环境中,由声音工程师用专业音箱设备在当时最高的音频通道标准下进行工作的(5.1、7.1等)。这种方法能够兼容消费者端各异的听音环境,确保下混到任意更低通道配置时仍能保持混音的条理以及语音对白的清晰。此种方法可行,但由于基于通道的格式在编码空间信息时的固有局限(前文已指出),因此缺乏空间精度。

向用户提供精准空间信息的一个更好的方法,则是将空间信息编码交给终端处理。由于配置是由用户直接设定,或与信号链中的其他设备对接(电视、Soundbar等),所以终端其实是最清楚用户接收音频信号的具体配置的。因此,终端可以用最合适的渲染方式将终混效果通过耳机或扬声器呈现。

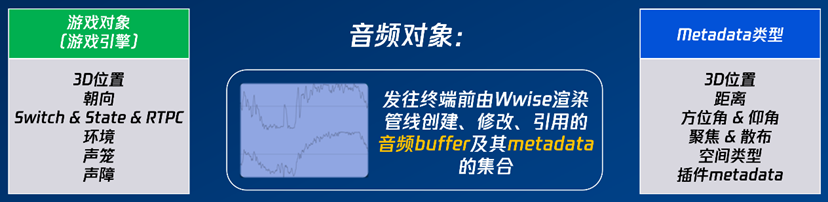

使用基于对象的方式,定向过程交由终端处理

而为了呈现最佳的定向效果,应用需向终端提供一系列音频对象及其相关metadata信息。更准确的说,音频对象是发往终端前由Wwise渲染管线创建、修改的音频buffer与其metadata的集合。附加到对象的metadata类型由Wwise生成,并与音频、插件信息相关联(参考下图蓝框内容)。此信息不应与游戏引擎(绿框)中游戏对象所携带的信息类型混淆。

音频对象(蓝框)metadata类型与游戏对象(绿框)提供的信息类型对比

总结

本文论述了由用户端实际设备来执行基于对象的音频渲染时,在空间音频质量和精度方面的优势。这种新手段,使空间音频体验更自然的同时,也对创作带来新的启发。更多内容将在本系列的下篇文章中做更多讨论。

评论