오브젝트 기반 사운드 시스템

몰입형 오디오 경험에 대한 시장의 요구는 7.1을 훨씬 뛰어 넘어 수직적 규격뿐만 아니라 평면적 수용력도 향상시킨 스피커 배열 구성을 개발하도록 만들었습니다. 이로 인해 Dolby Atmos(돌비 애트모스)및 DTS:X와 같은 서라운드 사운드 시스템 뿐만 아니라 MPEG-H와 같은 새로운 배포 표준이 등장함에 따라, 공간 음향 콘텐츠를 렌더링하는 스피커 구성을 추상화하기 위한 오디오 오브젝트의 개념이 고안됐죠.

채널 기반 오디오와 오브젝트 기반 오디오 간의 가장 중요한 차이점은, 채널 기반 오디오는 제작에서부터 재생까지 고정된 개수의 채널을 사용하며 특정한 스피커 구성을 위해 오디오 믹스를 설계하거나 단순한 스피커 설정을 위해 다운믹스되어야 한다는 것입니다. 오브젝트 기반 오디오는 '오디오 오브젝트' (즉, 모노 음원 + 청자에 관한 3D 좌표)가 반드시 보존되어야 하며 사용자의 스피커 구성에서 공간화하기 위해 장치로 전달되어야 함을 의미합니다. 다시 말해 오브젝트 기반 오디오는 '오브젝트' 혹은 오디오 요소를 개별적인 스트림으로 유지하고 각 스트림이 스피커 구성에 상관없이 3차원 공간에서 재생되어야 하는 위치를 설명하는 메타데이터를 담을 수 있게 해주죠. 오디오 오브젝트는 제작 도중 개별적으로 특정 공간 안에 정확하게 배치할 수 있으며 각 오디오 오브젝트는 '적응형 렌더링(adaptive rendering)' (스피커 구성에 따라 변함) 이라는 과정을 통해 실시간으로 알맞은 스피커 구성에 렌더링됩니다. 또한 적응형 렌더링을 사용하면 수신하는 쪽에서 믹스를 조정할 수 있습니다.

이러한 오브젝트 양식은 오디오의 바이노럴 가상화에 아주 적합합니다 (흔히 VR에 사용됨). 이 처리 과정은 보통 각 오디오 오브젝트를 필터(HRTF, 머리전달함수)로 통과시킴으로써 구현됩니다. 주파수 반응은 청자에 대한 음원의 3D 위치에 따라 달라집니다.

오브젝트 보존의 단점

오브젝트 기반 오디오는 렌더링 품질의 최적화를 공간적인 시점에서 바라봅니다. 하지만 오브젝트를 보존할 경우 중요한 음향 저작 작업과 호환할 수 없기 때문에 음향 설계 과정이 제한되죠.

예를 들어 사운드 디자이너가 한 사운드 그룹의 동적 범위를 제어하고자 한다고 가정해봅시다. 이 경우 보통 입력을 합해주는 버스에 컴프레서를 추가합니다. 다시 말해 서브믹스를 만들죠. 서브믹싱은 다음과 같이 다양한 목적으로 사용됩니다.

- 성능

- 사이드 체인

- 마스터링

- 미터링, 라우드니스(주: 인간이 주관적으로 느끼는 감각적 음량) 미터링

- 그룹화

Wwise에서 Master-Mixer Hierarchy(마스터 믹서 계층 구조)의 오브젝트는 이러한 목적을 위해 사용됩니다. 필요한 경우 버스를 믹싱 버스로 사용할 수 있죠.

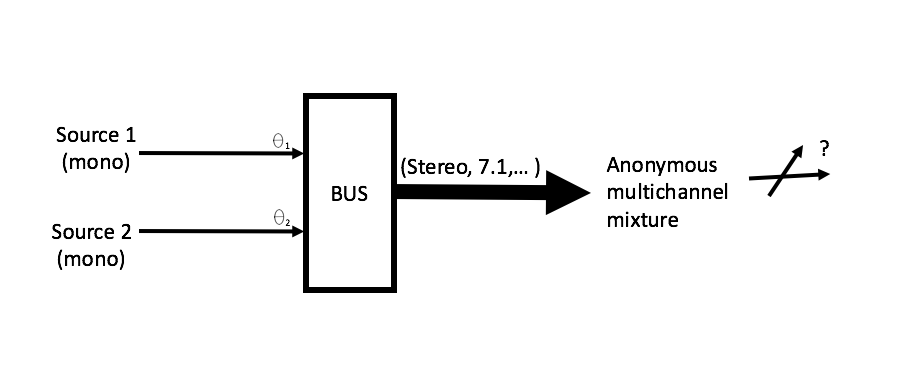

이제 두 개의 3D 음원을 믹싱 버스에 라우팅한다고 해봅시다. 이 버스의 출력에서 얻은 오디오 데이터는 여러 음원/오브젝트의 중첩(superposition)을 표시하는데 이 경우 구성 방향 요소를 잃게 됩니다.

그림 1 – 서로 다른 입사각을 가진 두 음원이 패닝되고 한 다채널 버스로 혼합되었습니다. 패닝 작업은 입력의 공간적 표현(여기서는 입사각 Ɵi으로 표현됨)을 출력의 공간적 표현으로 변환함 (예를 들어 신호를 7.1 스피커 구성에서 두 개 이상의 스피커로 배포)을 의미합니다. 패닝된 오브젝트의 혼합이 출력이 되며, 별도의 입사각을 갖지 않습니다 (이 출력은 앞에서 정의했던 오브젝트가 아닙니다).

그렇기 때문에 오브젝트 기반 오디오는 오브젝트가 믹싱 상류에만 존재하기 때문에 서브믹스와 호환할 수 없습니다. 이는 사운드 디자이너가 보통 서브믹스에 적용하는 저작 작업을 실행할 수 없게 제한해버리죠.

사례 살펴보기

Wwise의 믹서 플러그인 인터페이스는 오브젝트 기반 플러그인 구조를 하고 있습니다. 그 이유는 믹서 플러그인이 각 입력의 3D 위치에 접근하고 바이노럴화 된 음향을 제작하려면 각 음원이나 '오브젝트'를 사용해야 하기 때문입니다. 이러한 인터페이스가 바이노럴 가상화 장치에 구현하기에 아주 좋은 체계로 보이지만 사실 오브젝트 기반 오디오의 한계로 인해 설계 과정에 제약이 생깁니다.

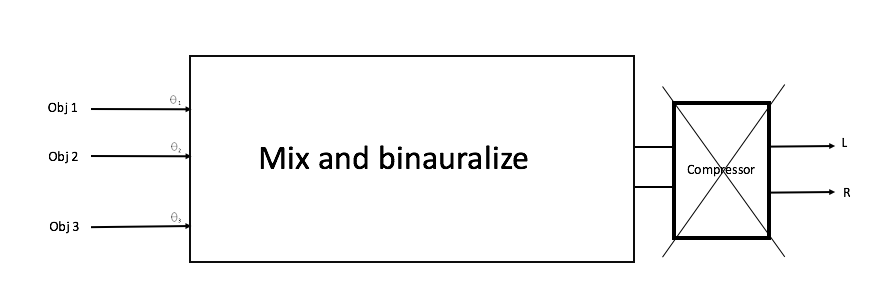

1. 바이노럴 신호에는 Effect를 추가하지 않아야 합니다. 왜냐하면 이 경우 바이노럴 처리를 통해 구현하고자 하는 공간적 음향의 환상을 깨뜨릴 수 있기 때문이죠.

그림 2 – 믹서 플러그인의 출력에서 바이노럴 신호의 하류에 잘못된 컴프레서 Effect를 추가했습니다.

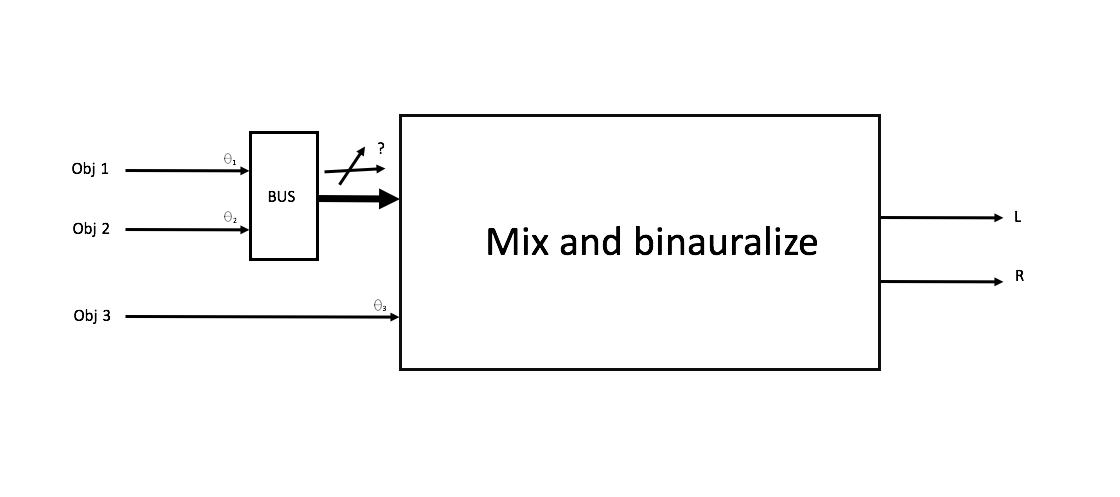

2. 믹서 플러그인의 상류에 믹싱 버스를 사용해서는 안되는데, 그 이유는 서브믹스가 바이노럴 처리에 필요한 3D 정보를 더 이상 담지 않게 되기 때문입니다.

그림 3 –믹서 플러그인의 상류에서 오브젝트를 믹스하는 모습. 서브믹스된 신호는 단일 오브젝트를 전달하지 않기 때문에 플러그인으로 바이노럴화할 수 없습니다.

그림 3 –믹서 플러그인의 상류에서 오브젝트를 믹스하는 모습. 서브믹스된 신호는 단일 오브젝트를 전달하지 않기 때문에 플러그인으로 바이노럴화할 수 없습니다.

절충안

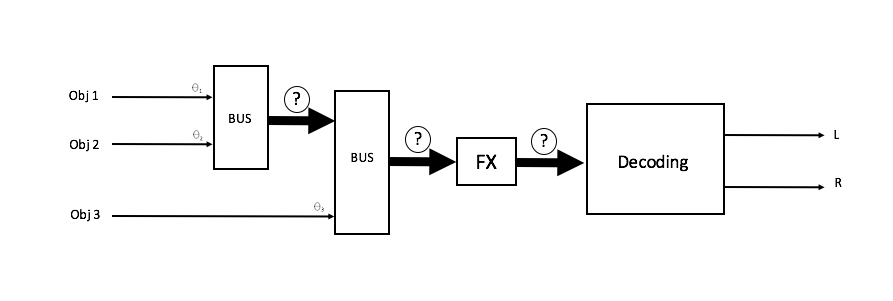

이 둘의 장점만 최대한 발휘할 수 있다면 얼마나 좋을까요? 오브젝트 기반 오디오의 단점 없이 제대로 된 공간적 정확도를 가진 오디오를 렌더링할 수는 없는 걸까요? 이러한 점을 앰비소닉이 어떻게 도와줄 수 있는지 기대해주세요!

그림 4 – 오브젝트가 자유롭게 서브믹스되고 다채널 공간 음향으로 패닝됩니다. 다채널 공간 음향은 모든 구성 요소의 방향적 강도를 전달하며 Effect같은 것을 추가하여 조작할 수도 있습니다.

댓글