私はビデオゲームのコンポーザー・サウンドデザイナーです。今日はインタラクティブなライブパフォーマンスでのWwiseの活用についてご紹介したいと思います。

最近パフォーマーのTiziana Continoと、『Classic Dark Words』プロジェクトで協業する機会がありました。より大きな『Typo Wo-man』というプロジェクトの中の作品で、身体全体を使ったジェスチャーを文字に変換してゆき、ボディアルファベットのように表現し、さらにパフォーマンスアートとダンスへと発展させて身体でしか伝えられないストーリーを演出するというものです。

アルファベットをパフォーマーの身体だけで作成し、文字を用いた感情表現、身体の気分の記録となります。このアルファベットが一種の用語集となり、これら用語はパフォーマンスと並行して開発したアプリに変換され、観客はこのアプリを通して意思表示ができます。アプリを通してナレーションを構築し、それをTiziana Continoが身体で演じるというかたちでインタラクションが可能となり、毎回異なるパフォーマンスとなります。視覚的な文脈と聴覚的な文脈を繋げるのが私の役割で、音楽およびWwiseでリアルタイムに演出します。私たち2人は、観客がタブレットからアプリに書き込む言葉をパソコン画面で確認しながら、それに反応します。以下は私たちのパフォーマンス例を紹介する動画です:

『Classic Dark Words』の音楽の背景

私はTiziana Continoが作成した用語集を参考に、『Classic Dark Words』の音楽パフォーマンスをつくりました。惑星が太陽や月などの天体と持つ関係を見出したのです。さまざまな秘教書を探り、天体とメジャースケールの旋法(イオニア、ドリア、フリギア、リディア、ミクソリディア、エオリア、ロクリア)との関連性を感じ取りました。

そして私は自問しました。

「どうすれば上演中にキーボードを弾き、シンセ音をかたちづくりながら、自分で旋法を切り替えることができるだろう」と。

その答えはWwiseにありました。

しかしその前に音楽理論について少し話し、これら旋法と天体の間の比喩的な関係の理解を深めたいと思います。

音楽理論を少しだけ

音楽理論において、scale degreeは音階のルートに対する特定の音の位置を表します。例として、Cメジャー・スケール(C - D - E - F - G - A - B)を見てみます。音階のすべての音にそれぞれ機能があり、ルートが変わった場合もその機能は変わりません。よって以下のようになります:

C:Tonic

D:Supertonic

E:Mediant

F:Subdominant

G:Dominant

A:Submediant

B:SubtonicまたはLeading Tone

その代わり、メジャースケールの特徴を決めるのが全音(W)と半音(H)のパターンです。例えばCメジャースケールの場合、パターンが次のようになります:W-W-H-W-W-H。

全音と半音のパターンにより、音階の旋法(この場合はイオニア)が決まります。ルートを Fに変えた場合(F-G-A-B-C-D-E)、全音と半音の順番はW-W-W-H-W-Hとなります。BをBbに変えていないことに注目してください。Bナチュラルがこの旋法(この場合はリディア)を決定する特徴的な音であるため、これは重要です。

簡単ですよね。全音と半音の順序を変えるだけで世界が変わります。音楽的な意味だけでなく、音楽に対する知覚や感情が変わります。どの旋法にも以下のように、独自の味、感覚、感情があります。

イオニア(W-W-H-W-W-H):非常にポジティブ、陽気、祝祭的

ドリア(W-H-W-W-H-W):古代、瞑想的、まろやか

フリギア (H-W-W-H-W-W):不思議、エキゾチック、神秘的

リディア(W-W-W-H-W-H):超現実的、幽玄、浮遊

ミクソリディア (W-W-H-W-H-W):元気、楽観的

エオリア(W-H-W-H-W-W):感傷的、静か

ロクリア (H-W-W-H-W-W-W):混沌、緊迫、催眠的

ここで1歩前に戻り、天体と旋法の関係性について考えてみましょう。

天体と音楽の関係

ローマ神話によると、惑星や天体はそれぞれ固有のエネルギーや性質を有しています。例えば木星は常に喜び、楽観主義、広がりなどと関連すると考えられていました。そうであれば、活発性と楽観性を示すミクソリディアで音楽をつくってみては?これこそ私が探していた「繋がり」でした。

実際、私は『Classic Dark Words』のために7曲を作曲しました:

イオニア→太陽→癒し、曲名はHealing Sun

ドリア→土星→古代、曲名はAncient Saturn

フリギア→金星→神秘的、曲名はMystic Venus

リディア→火星→はやい、曲名はFast Mars

ミクソリディア→木製→成長、曲名はGrowing Jupiter

エオリア→月→静けさ、曲名はQuiet Moon

ロクリア→水星→世界、曲名はWorlds of Mercury

こちらのYouTubeプレイリストで7本のトラックを聞くことができます:

作曲とWwiseの実装

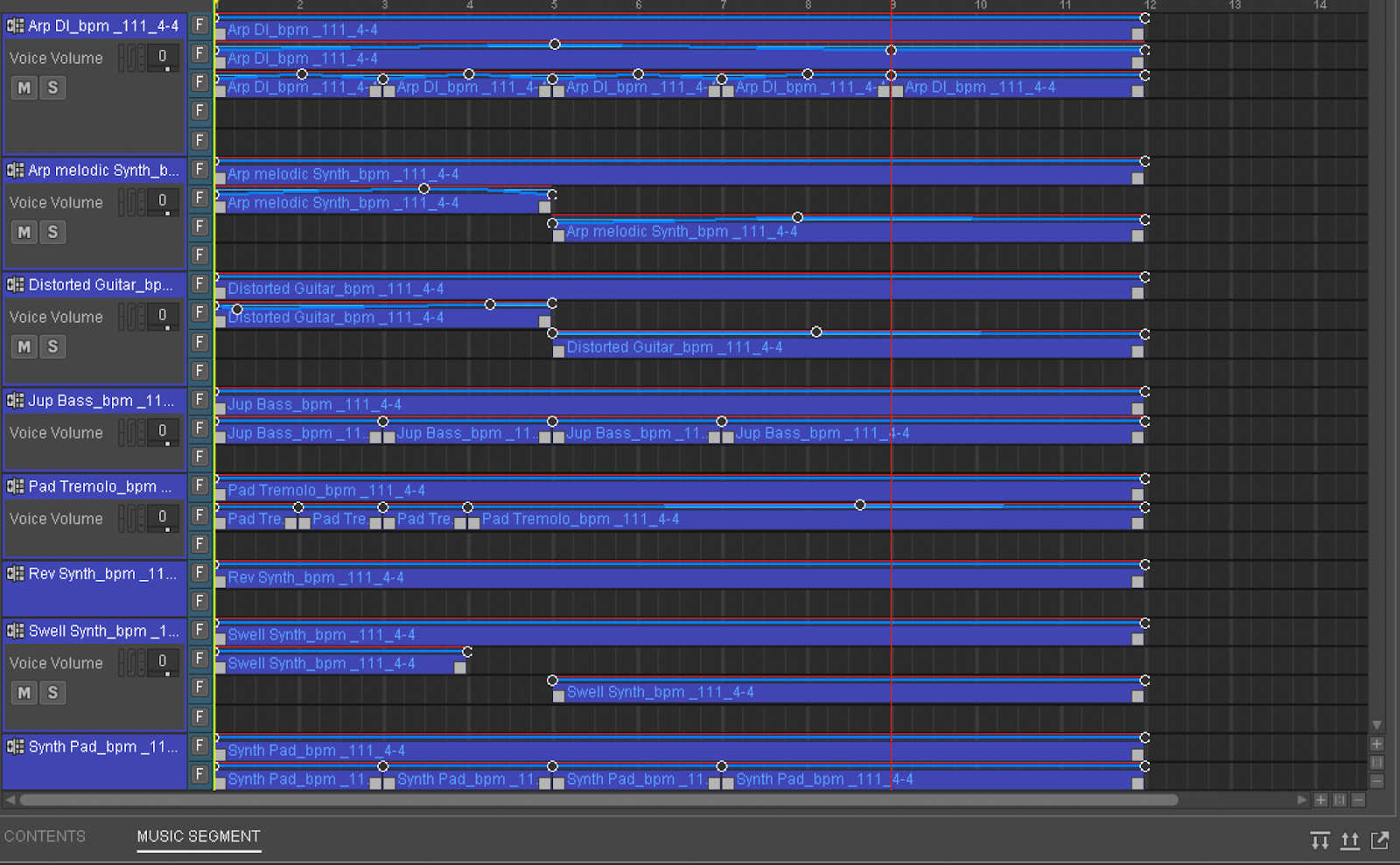

曲を7曲つくることはそれほど難しくなく、時間が多くある場合はなおさらです。ただ今回は旋法やムードをリアルタイムにWwiseで操作するつもりであったため、単純にトラックごとに8小節ずつ作曲することにしました。

私はビデオゲーム音楽でよく使われるバーティカルレイヤーという作曲テクニックを使うつもりでした。

バーティカル(垂直)にレイヤーを重ねる作曲では、複数の使い方が考えられる1つのトラックがあります。例えばキャラクターが森にいる時はエクスプロア音楽が聞こえてきます… パッドといくつかの弦楽器コードの演奏を思い浮かべてください…ところがプレイヤーの知らないところで複数のパーカッショントラックがミュートになっており、コンバット開始と同時にレイヤーに加わるため、待ち受けています。

バーティカルレイヤーの設定方法にもよりますが(Switch、RTPCなど)、キャラクターが敵に遭遇した時にコンバット音楽のレイヤーがフェードインし、エクスプロア音楽および戦闘を強調する民族的なパーカッションが聞こえてきます。これは今回のパフォーマンスにぴったりのテクニックであると思いました。私がSwitchグループの切り替えやRTPCの調節などを行えないため(実はRTPCをほかの目的に使用しましたが、詳細は後ほど)、サブトラックを利用したレイヤードアプローチで、Wwiseに少しランダム性を与えることにしました。

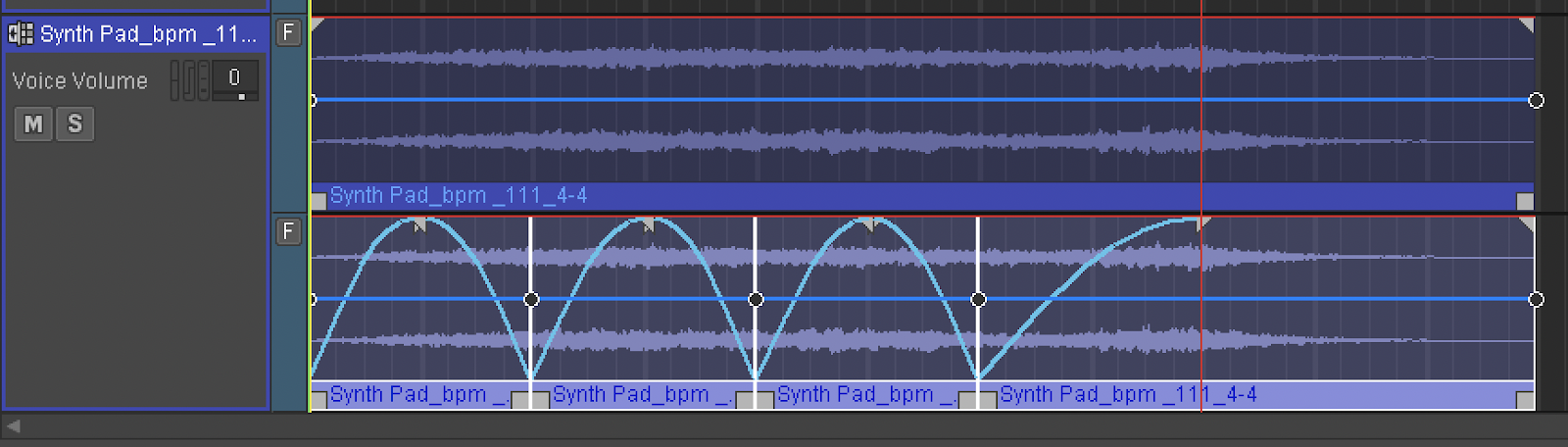

30秒ほどの音楽でバリエーションを出すツールとして、Music Segmentのサブトラックは非常に優れています。

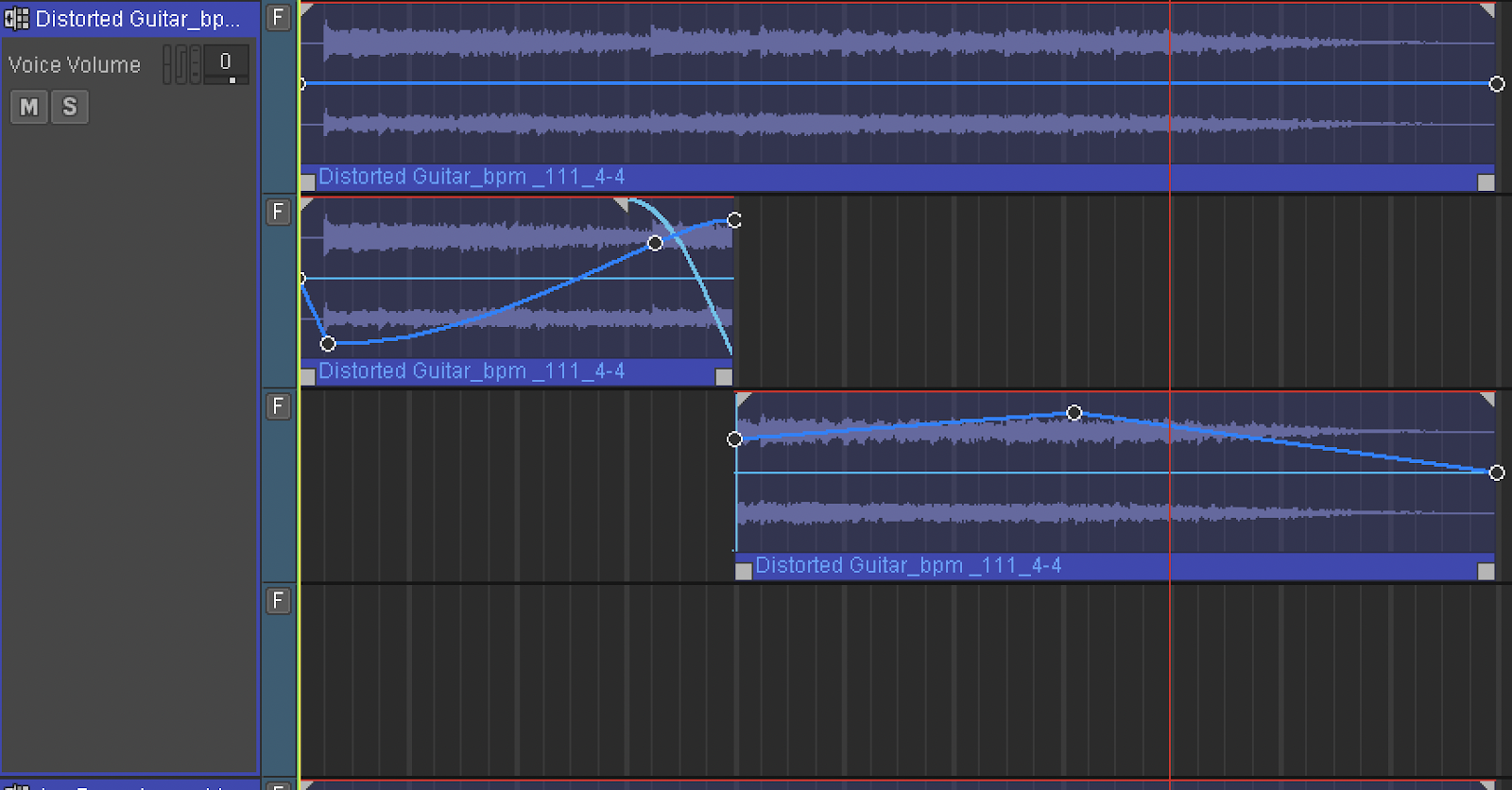

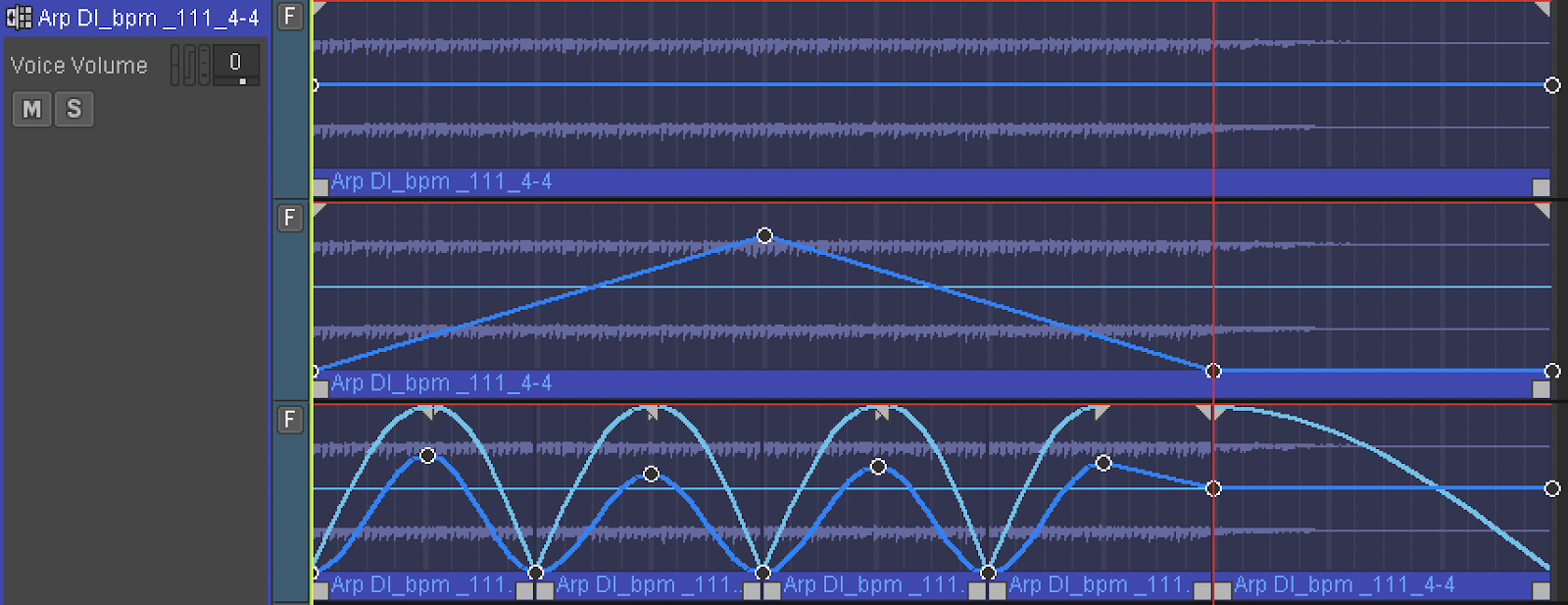

詳しく見ますと「常時オン」状態のトラックが1つあり、これが常に再生されています。このシンセトラックはベースサウンドを接合するために、すべての曲に入っています。これが旋法を決めるコードの基本構造となります。私はあるトラックをダイナミックスごとエクスポートし、1つのサブトラックに使いました。別の場所では、Wwiseでフェードイン・フェードアウトをつくりました。

ボリュームやローパスフィルタ・ハイパスフィルタにオートメーションを使用した場合もあります。私は同じトラックをコピーし、均等に2つに分けました。分割した最初のトラックは最初の4小節でギターが流れます。2つ目のトラックは最後の4小節で流れます。

きわめてランダムにし、繰り返しを少なくするため、今回はあえてMusic Segmentのシーケンストラックを使いませんでした。

オーディオクリップの聞こえ方を変えるためには、同じオーディオクリップを使いパラメータを変化させることが重要です。

はじめにすべての旋法ですべてのMusic Segmentサブトラックを設定し、次に私はMusic Playlist Containerを作成してMusic Segmentを無限にループできるようにしました。

もう1つ私が工夫した点で強くおすすめしたいのが、全体的な色分けです。

これには次の2つの理由があります。

- 大きなプロジェクトでは整理整頓と生産性向上のため、色分けが欠かせません。

- チームで作業する場合、特にビデオゲーム業界においては、ほかのコンポーザーやサウンドデザイナーたちと仕事をするはずです。色分けの仕方の統一は、のちに複数の関係者から渡されるワークユニットをマージする時に役に立ちます。

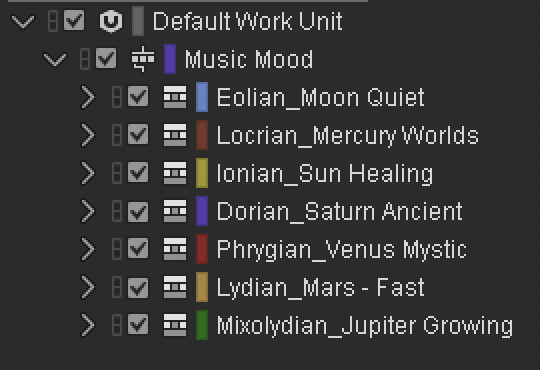

今回は旋法の第1印象に合わせ、Music Playlist Containerの色分けを決めました。

ご覧の通り、すべてのMusic Playlist Containerを1つのMusic Switch Containerに入れた後、クリック1つでプレイリストを変更できるようにする必要がありました。この切り替えのために使ったのがWwiseのStateです。Stateを使い、ビデオゲームのプレイヤーキャラクターの状態をゲームプレイに応じて「生」「死」「勝利」「敗北」などと変更できるように、ゲームステートで音楽を変えることができます。

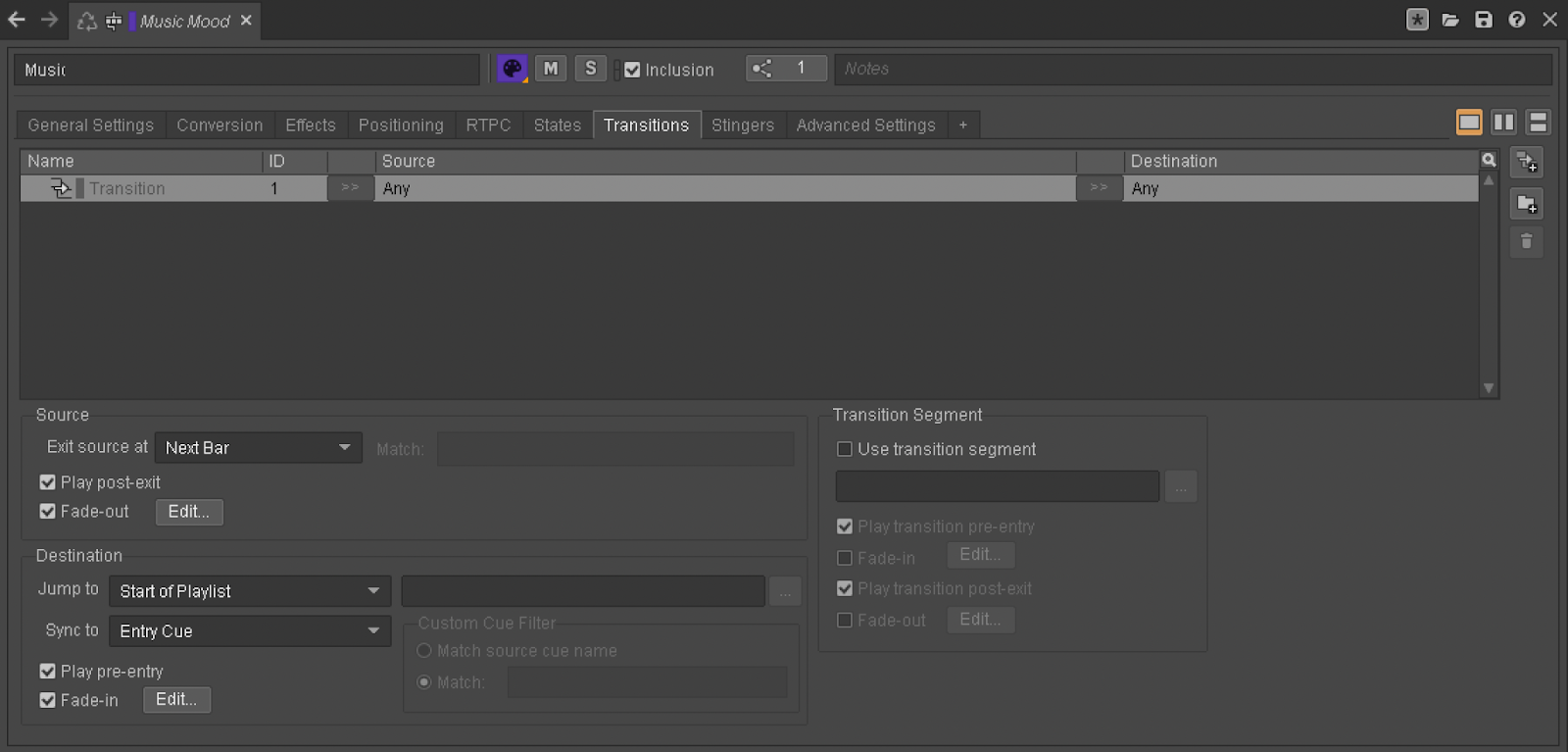

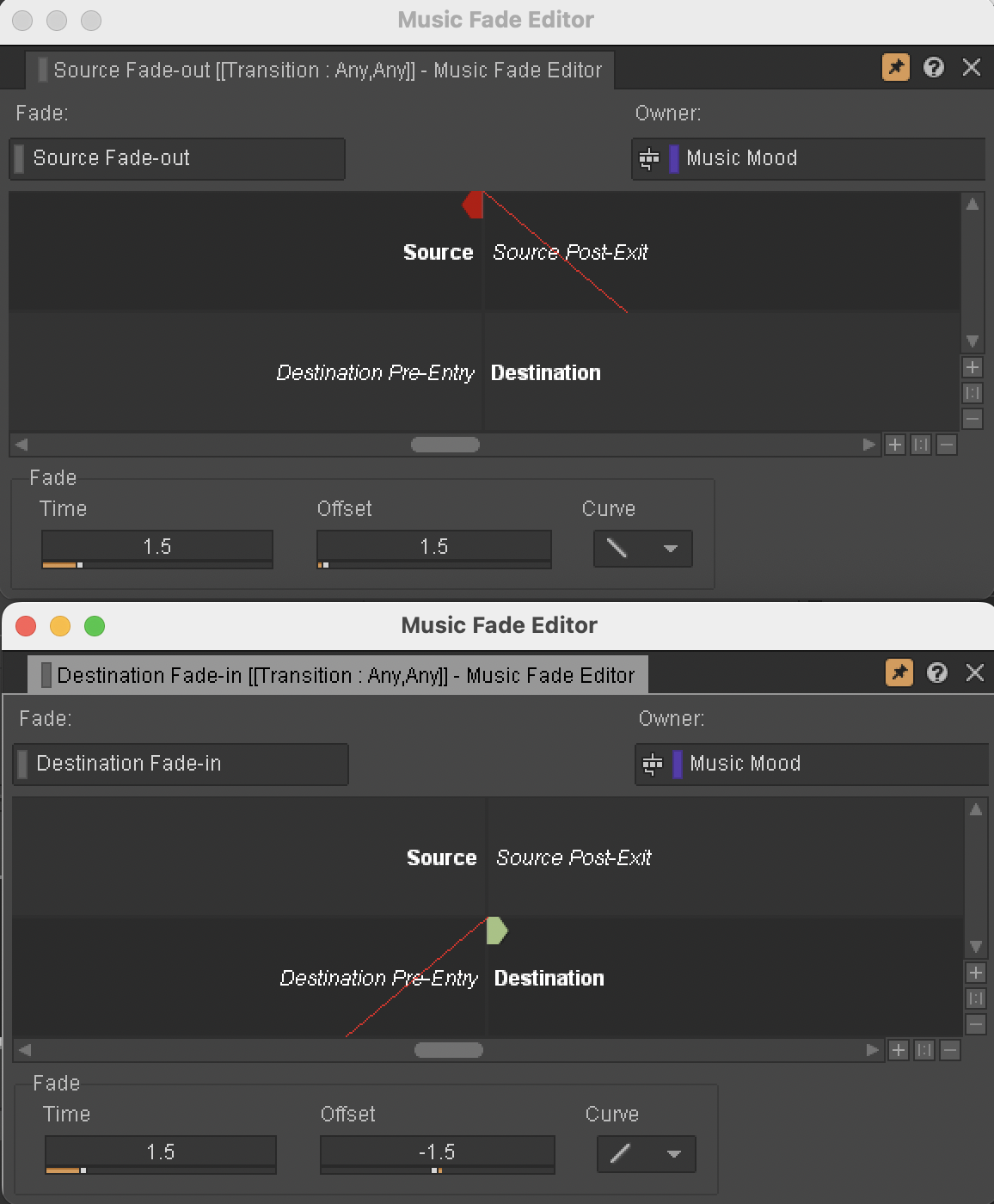

今回のプロジェクトでは、各旋法にStateを設定しました。これによりMusic Playlist Container内のMusic Segment間をスムーズに移行できるようになりました。下図の通り、トランジションに特別なルールを設定したわけではありません。「Any to Any」(デフォルト)のトランジション設定をExit Source at Next Barとし、フェードアウト・フェードインのタイミングも設定しました。

こうして私の音楽パフォーマンスはトランジションをプレイすることに重点を置き、パフォーマンス中にシンセをつくり、イベントの参加者によってアプリを通して表面化される言葉を発展させ、音楽、ムード、モード(旋法)、そして表現に貢献しました。

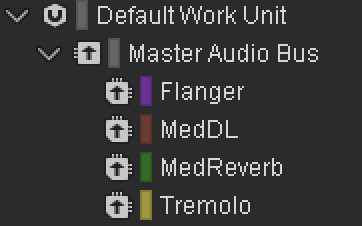

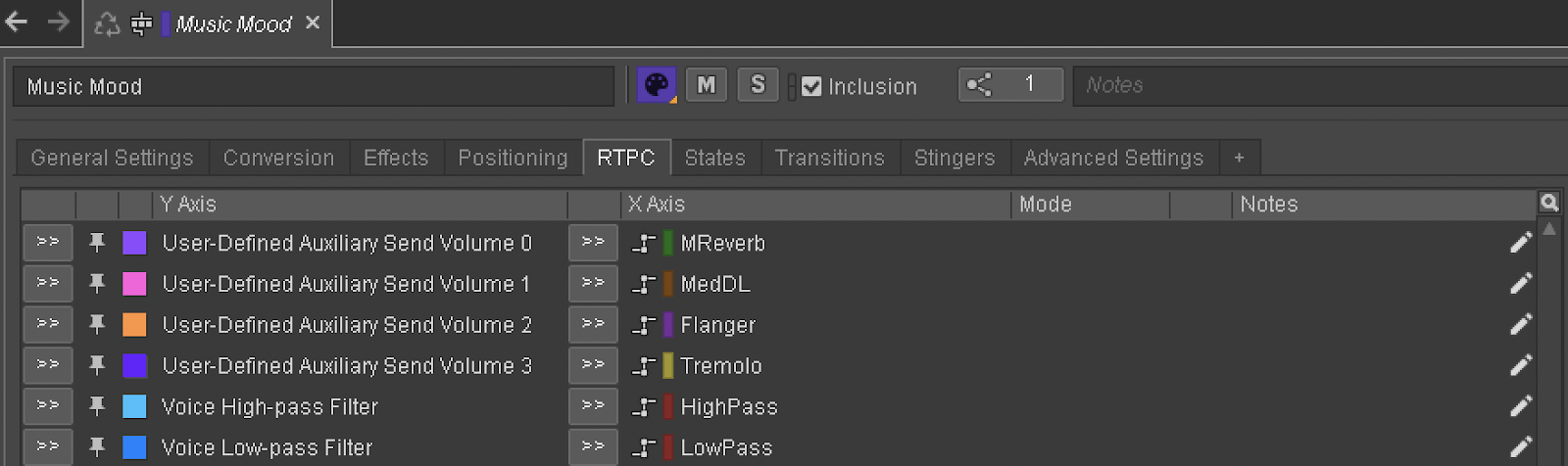

オーディオパフォーマンスをクリエイティブに操作できるよう、私はRTPC(リアルタイムパラメータコントロール)を利用してリバーブ、ディレイ、フランジャー、トレモロの音量を変化させました。ハイパスとローパスのコントロールも取り入れました。ついやり過ぎてしまいそうで、ある時点でFXを追加することを意識的にストップしました。ピッチの操作も検討しましたが、パフォーマンス全体の目的を鑑みた上、この時点ではあまり意味がないと判断しました。

各FXのAuxiliary Busを作成した後、下図のようにMusic Playlist ContainerにリンクされたRTPCを使用しました。

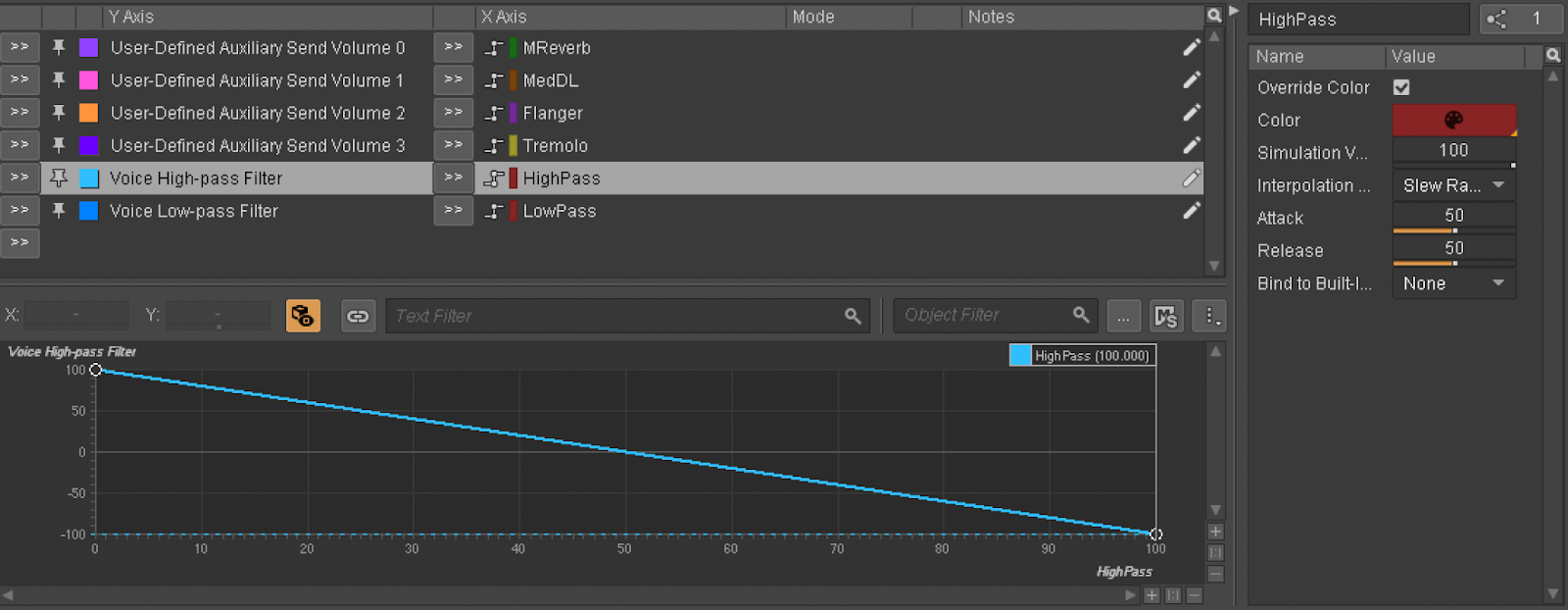

エフェクトがすぐにターゲット値に飛んでしまうことを回避しつつ、ハイパスフィルタ・ローパスフィルタ(そしてFX全般)を制御しやすくするために、Game Parameter InterpolationをSlew Rateに設定し、AttackとReleaseを50に設定しました。これにより、RTPCが変化した時の値の切り替わりがスムーズになりました。

ミックスのセンド値のように、ハイパスフィルタやローパスフィルタを刺激する時に使うGame Parameter値を、0~100の値で作成しました。

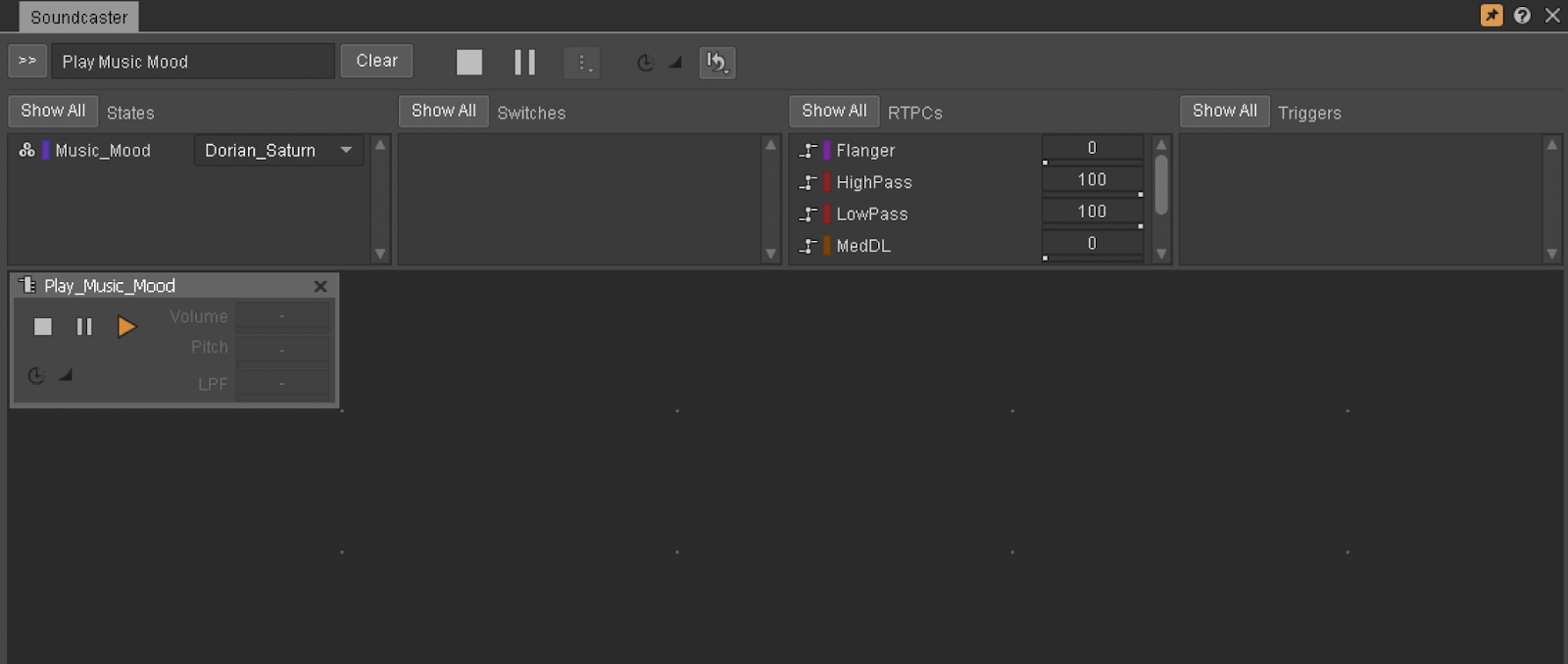

その後にSoundcasterのセッションで、すべてをテストしました。

私はSoundcasterセッションを本番前のテストに利用しただけでなく、メインの音楽制御システムとしても使いました。Music Playlist Containerを参照する“Play_Music_Mood”イベントを開始させ、旋法から旋法へ切り替えるためにStateを変えることができました。さらにマウスでRTPC値を変えることもできます。これらの変更はすべてTizianaのパフォーマンス中、そして私がMIDIキーボードを弾いている最中に、リアルタイムで行われました。

ここで指摘しておきたい重要なことですが、Music Segmentサブトラックのランダム性に、本番中に助けらました。例えばアプリに「Anxiety(不安)」いう文字が出た時、私は当然できるだけはやくロクリア旋法を再生するため、Stateを切り替えました。さらにRTPCを使いローパスフィルタを追加したところ、驚いたことにドラムが心臓の鼓動のように聞こえてきました。選択したサブトラックは私が事前に編集したものであり、鼓動は不規則であったため、不安感は増すばかりでした。これぞランダム性とクリエイティブな発想の結びつきから生まれる魔法です。

まとめと次のステップ

これをお読みいただき、あなたもクリエイティブで一般的ではないアプローチでWwiseを使ってみる気になったでしょうか。もちろんこの記事ではパフォーマンスに非常に柔軟に対応することのできる、大規模なプロジェクトのほんの一部を紹介しています。私はすでに今後のパフォーマンスのための新たな計画を立てており、旋法と旋法の間のトランジションセグメントを増やし、アダプティブ要素を追加し、Music Playlist Containerを拡張したいと考えています。

今回の音楽を聴きたい方はSpotifyバージョンをチェックしてください。元のライブパフォーマンスほどアダプティブ性はありませんが、私の解釈するところの『Classic Dark Words』を体感することができます。本パフォーマンスの音楽を、リニア形式で聞くことができます:https://open.spotify.com/intl-it/album/2GDOP0O3EapUtSwc4rXIzb?si=x9mG1MdBQ7eRmziGDgB0xQ

コメント