長い間、「アンビソニックス」はアンビエンスの作成やオーディオシーンのレコーディング手法として捉えられ、特別なマイクを使った空間的な特徴を捉えることが主な目的であるとみられていました。

今回は、中間的なスペーシャル(空間的)表現としてアンビソニックスを紹介しながら、VR(バーチャルリアリティ)用のバイノーラルレンダリングを可能にして単純なオブジェクトベースのオーディオの欠点を回避してくれる側面に注目したいと思います。

バイノーラル化を目的とした、中間的なスペーシャル表現

VRのゲームはヘッドフォン用に、バイノーラルミックスにレンダリングする必要があり、ポジションに応じたHRTF(Head-Related Transfer Functions / 頭部伝達関数)というフィルターにサウンドを通すことで行います。このフィルターはサウンドと頭部のやり取りをモデル化したもので、ゲームのサウンドが実際にプレイヤーの頭部外で発生しているかのような印象を与えることができます。

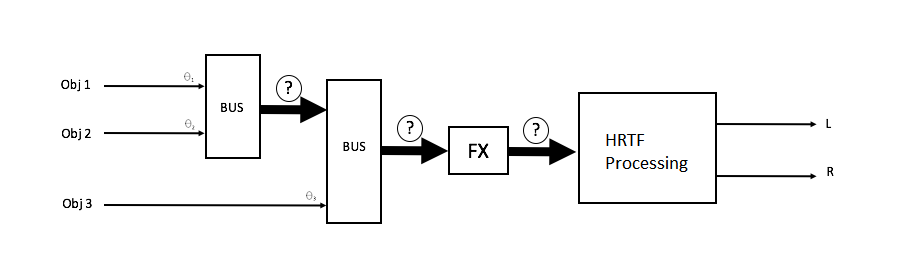

正確にHRTFをバイノーラル処理に適用するには、ソースがどの方向から向かってくるのかを知る必要があります。その方法の1つが、ポジション(位置)を有するソース毎にフィルターをかけることです。ただし、ソースを1つずつパンニングしてバイノーラルフィルターを適用してしまうと、それなりの問題が発生します(アンビソニックス連載の前回のブログを参照)。特に、ダイナミックレンジの圧縮などのオーディオEffectを適用するためにサウンドをグループにまとめてサブミックスしたいとサウンドクリエイターが考えても、できません。このような欠点を埋めるには、パンニング処理とバイノーラル処理を2つの段階に分けなければいけません。その間に必要なのが、サブミックスされるオーディオを構成する各種サウンドのスペーシャル(空間配置)特性に関する情報を維持ことができる、信号(シグナル)フォーマットです。このフォーマットを私達は"intermediate spatial representation"(空間配置の中間的な表示)と呼び、下図のクエスチョンマークで示しています。

図1 – オブジェクトを自由にサブミックスしてから、マルチチャンネルの空間的オーディオ配置にパンニングするので、全ての要素についてそれぞれの方向性で強弱を感じ取ることができ、Effectを追加するなどして、更に変化させることもできます。

図1 – オブジェクトを自由にサブミックスしてから、マルチチャンネルの空間的オーディオ配置にパンニングするので、全ての要素についてそれぞれの方向性で強弱を感じ取ることができ、Effectを追加するなどして、更に変化させることもできます。

HRTF処理のあとに出されるバイノーラルシグナルにも空間関連の情報が入っていますが、それと比較してintermediate spatial representationは編集可能で、入れ替えたりマスタリングしたりでき、レンダリング環境(ラウドスピーカーのセットアップやHRTFの設定など)から、ある程度独立しています。

"仮想ラウドスピーカー" による表現

Intermediate spatial representationに適した1つの方法が、「仮想ラウドスピーカー」です。仮想ラウドスピーカーのコンセプトは、かなりシンプルです。マルチチャンネルフォーマットで構成され、それぞれのチャンネルが、既知の固定されたポジションにある1つの仮想ラウドスピーカーに該当します。サウンドは標準的なパンニングの法則に従いマルチチャンネルフォーマットにパンニング、ミキシングされ、あとからチャンネル毎のシグナルを、該当する仮想ラウドスピーカーのポジションに合ったHRTFを使い、別々にフィルターにかけます。

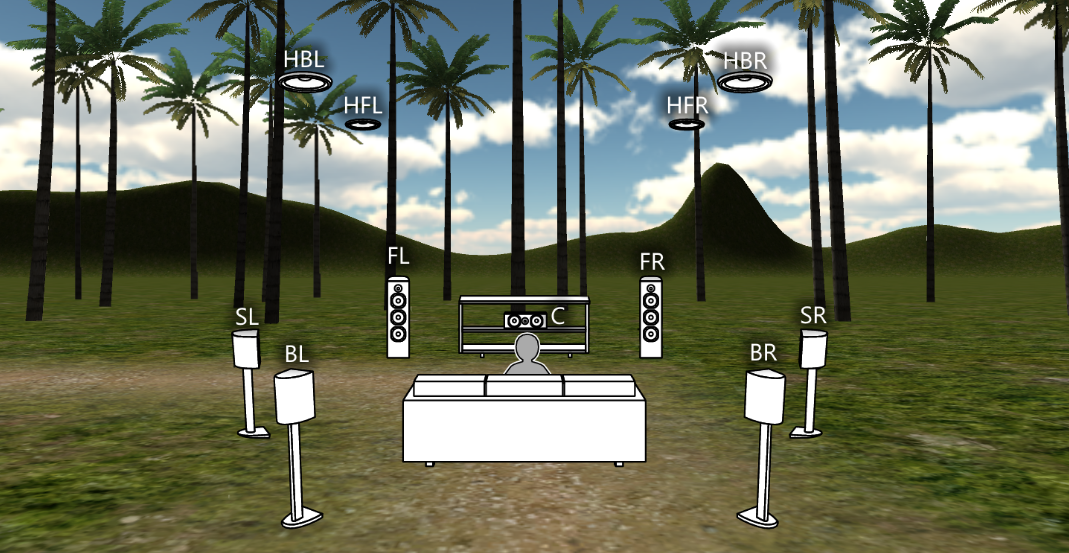

図 2 - 各チャンネルがリスナー周りの仮想ラウドスピーカーとして表示された、仮想ラウドスピーカーのイメージ図 (リスナーとは、ファーストパーソンシューティングゲームではカメラ、サードパーソンシューティングゲームではアバターのこと)。VRゲームでは、仮想ラウドスピーカーのそれぞれのシグナルが、そのスピーカーの固定ポジションに対応したHRTFを経由して、ヘッドフォンミックスの両耳用に出されます。

実は、仮想ラウドスピーカーによる表現は、従来のマルチチャンネルシグナルと変わらないのです。唯一の違いは、使われている状況です。本来の5.1Chセットアップでは5.1バスに対してサウンドが直接パンニングとミキシングされ、このバスの1チャンネルが、実際のスピーカー1台から出す音のために使われます。一方、今回のケースではアウトプットのチャンネル数(2)よりも意図的に多くのチャンネル数を有するコンフィギュレーションに対して、パンニングさせます。仮想ラウドスピーカーのチャンネルに黙示的に伝えられた指向性の情報が、フィルターを通すことでバイノーラルシグナルに落とし込まれます。

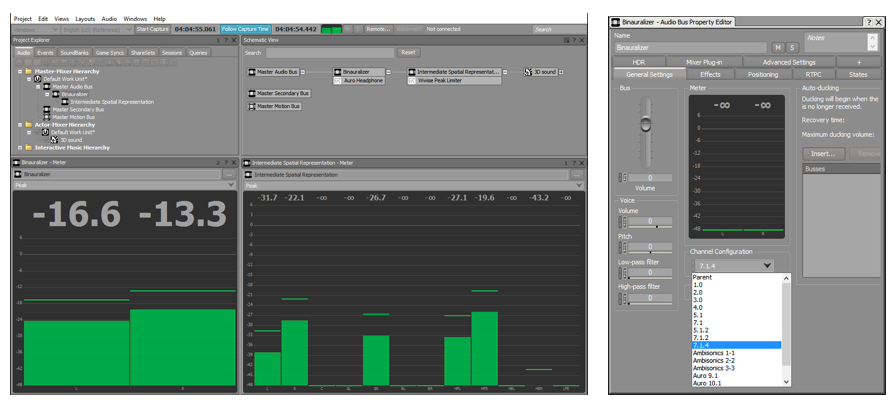

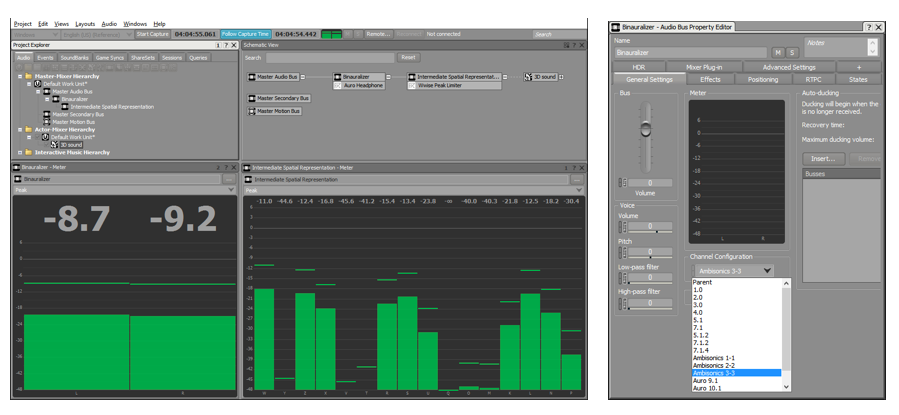

Wwiseでこの手法を実践するには、3Dサウンドをintermediate spatial representation専用のオーディオバスにルーティングして、その親でバイノーラルレンダリングを行うという方法があります。この場合、後者にバイノーラルEffectが、前者にマスタリングEffectが(必要に応じて)設定されます。

左図を拡大するには、ここをクリック 右図を拡大するには、ここをクリック

図 3 - Project ExplorerとSchematic Viewで示されるように、Wwiseで仮想ラウドスピーカーの仕組みを設定します。バスを両方とも、標準的なマルチスピーカーコンフィギュレーション、例えば7.1.4などに設定します。リスナーより高い位置から聞こえるサウンドを表すために、Heightチャンネルは必須です。

アンビソニックス

アンビソニックスも、intermediate spatial representationの一種ととらえることができます。それぞれのチャンネルに球面調和関数(spherical harmonic)と呼ばれるものが付随していて、それらがお互いを補完しあうことでサウンドフィールド(音場)が作り出されます。1次アンビソニックスは、W、X、Y、Zの4チャンネル(FuMa表記)で構成されます。Wは無指向性(omni)チャンネルと呼び、方向性に依存しないシグナル用です。X、Y、Zは、方向性に依存する主要3方向(front-back、left-right、top-down)のオーディオ用です。

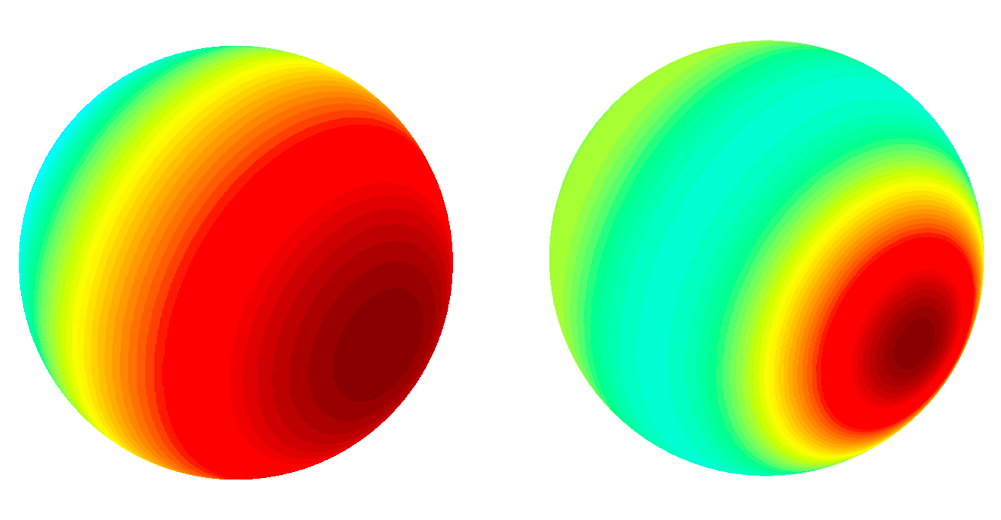

HOA(Higher-Order Ambisonics、高次アンビソニックス)はイメージ化するのが難しいですが、高次とは空間的な正確さを高める追加データが含まれるもの、とここでは解釈します。2次アンビソニックスは9Ch、3次アンビソニックスは16Chから成り、その分、精度が増します。

図 4 - 1次アンビソニックス(左)と3次アンビソニックス(右)を使って表現した点音源。色温度が高いほど、信号エネルギーが高くなります。

アンビソニックスの用語として、アンビソニックスに対してパンニングすることがエンコードに該当して、アンビソニックスをバイノーラルセットアップやラウドスピーカー入力に変換することがデコードに該当します。

7.1.4セットアップなどの典型的な仮想ラウドスピーカー配置と異なり、アンビソニックスは左右対称で全方向に向かって均一であり、リスナーより下位の音源も表せます。ただし、アンビソニックスは同じチャンネル数の仮想ラウドスピーカーよりも、音がぼやけてしまいます。アンビソニックスは一定したスプレッド(広がり)を見せ、スピーカーにおける振幅パンニング(amplitude panning)は、スピーカーと全く同じ位置にバーチャル音源がくれば精度は高くなりますが、取り囲む3つのスピーカーの中央にある場合は、精度が下がる可能性があります。

Wwise v2016.1でアンビソニックスをintermediate spatial representationとして実装するのは、仮想ラウドスピーカー方式と同じくらい簡単です。バスをアンビソニックスコンフィギュレーションに設定するだけです。空間的な配置の精度を高めるに、高次アンビソニックスが推奨されます。

左図を拡大するには、ここをクリック 右図を拡大するには、ここをクリック

図 5 - Project ExplorerとSchematic Viewで示されるように、Wwiseでアンビソニックスのintermediate spatial representationを設定します。バスを両方とも、アンビソニックスコンフィギュレーションに設定します。空間的な配置の精度を高めるには、高次アンビソニックスが推奨されます。

現在、既にアンビソニックスシグナルを受けてバイノーラルへ仮想化できるSDKを提供するベンダーが、数社あります。リリースされれば、これらのVRデバイスにアンビソニックスをWwiseから直接送り込むことができるようになります。それ以外にも、アンビソニックスをデコードしてお気に入りの3Dオーディオプラグインを使ってバイノーラルに変換することも可能です。Wwiseと共に提供中のAuro Headphoneは、そのようなプラグインの1つです。

最後に、ワークフローにintermediate spatial representationをインテグレートしてアンビソニックスを採用するもう1つのメリットは、交換フォーマットとして利用できることです。

VRより先のアンビソニックス

最近、このワークフローをiX SymposiumのSATドームで試しました。アンビソニックスバスをバイノーラル用にデコードするのではなく、Wwiseのデフォルトのアルゴリズムを使い、31ヶ所にラウドスピーカーが配置されたドームの実際のラウドスピーカーセットアップに対してデコードしました。

観客と一緒に行ったおもしろい実験をここでご紹介します。次の3種類の空間化の戦略を用いて、ヘリコプターが頭上を通り過ぎる様子を参加者に聞き比べてもらいました。

- スピーカー31台に直接、パンニングする。

- 3次アンビソニックスにエンコードしてから、スピーカー31台向けにデコードする。

- 1次アンビソニックスにエンコードしてから、スピーカー31台向けにデコードする。

1次アンビソニックスの方がはるかに「広く」聞こえるように受け取られたのに対し、参加者の大半は3次アンビソニックスの方が、直接パンニングの方式に正確さの観点で近いと感じたようです。

Spatial audio(空間的オーディオ)に関するこの連載では、次にアンビソニックスのパイプラインをシネマ系VRに使う方法を探りたいと思います。アンビソニックスパイプラインの更なるメリットや使い方について、今後のブログもお楽しみに!

ルイス・ハビエル・ブッフォーニ (LOUIS-XAVIER BUFFONI)

Audiokinetic R&D部門ディレクター

ハビエル・ブッフォーニは、Audiokineticの空間オーディオの研究リーダーです。電気工学の修士号を有し、様々な記事や講演などで、インタラクティブミュージック、HDRを使ったダイナミックミキシング、また最近ではオブジェクトベースのパンニングやアンビソニックスについての情報を提供しています。また、AES for GamesやMIGSなどの業界イベントで、数々のプレゼンテーションを行ってきました。

コメント