Introduction

Dans cet article, nous nous concentrerons sur la fonctionnalité AudioLink d'Unreal Engine.

Le bon fonctionnement de ce processus a été validé avec les versions suivantes.

- Wwise 2023.1.3.8471

- Unreal Engine 5.3.2

Veuillez noter que différentes versions peuvent fonctionner d'une autre manière.

Table des matières

Introduction

Table des matières

C'est quoi, AudioLink ?

Diagramme : Comment ça marche ?

Préparation d'un nouveau projet

Intégration et création d'un projet

AudioLink - Configuration

Paramètres du projet Wwise

Configuration de l'intégration Unreal

Paramètres Unreal (optionnel)

Paramètres de Sound Attenuation

Paramètres de Sound Submix

AudioLink – Jouer un son

Lors de la spécification d'une Sound Attenuation (module Blueprint)

Lors de la spécification d'une Sound Attenuation (Audio Component)

Lors de la spécification des paramètres Wwise d'AudioLink

Sound Submix

Conclusion

C'est quoi, AudioLink ?

AudioLink est une fonctionnalité d'Unreal Engine disponible à partir d'Unreal Engine 5.1 permettant d'utiliser le moteur audio d'Unreal avec un intergiciel comme Wwise.

Cela vous permet d'utiliser simultanément les solutions sonores propres à UE, telles que MetaSounds, en combinaison avec un intergiciel audio tel que Wwise.

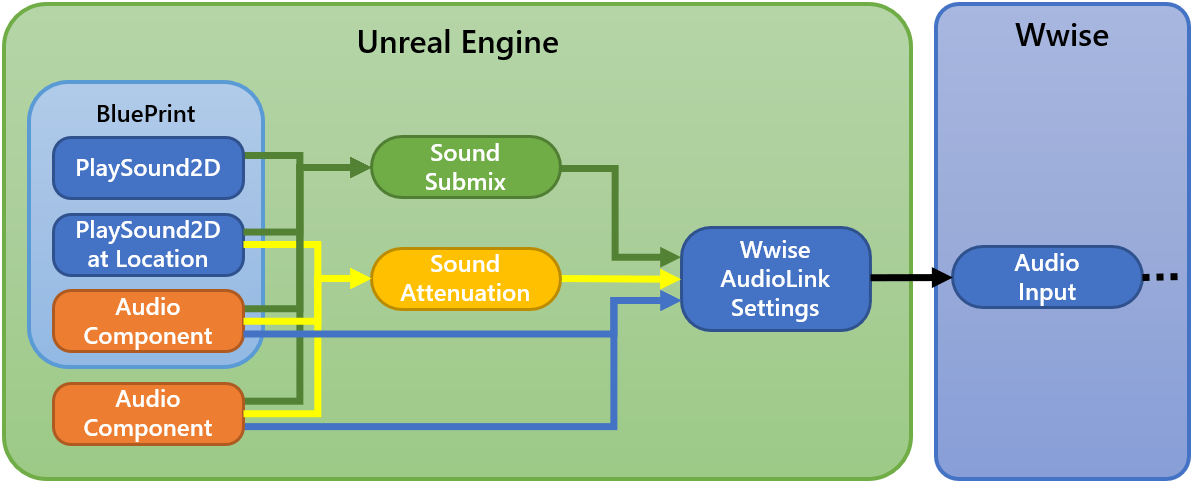

Diagramme : Comment ça marche ?

En partant de la droite, du côté de Wwise, le plug-in Audio Input reçoit la sortie d'AudioLink, qui est gérée par les paramètres (« Settings ») Wwise d'AudioLink. En outre, le paramètre Sound Attenuation contient les réglages des paramètres Wwise d'AudioLink. (Note : Ici, Sound Attenuation (« atténuation sonore ») est un asset d'Unreal provenant de leur système audio. AudioLink ne fonctionne que si votre son Unreal utilise un paramètre de Sound Attenuation.)

Dans Unreal Engine, certains modules de Blueprint vous permettent de spécifier le paramètre de Sound Attenuation comme méthode de sortie, alors que d'autres ne vous permettent pas de spécifier quoi que ce soit.

Les Audio Components tels que Sound Cue et MetaSound vous permettent de spécifier un paramètre de Sound Attenuation ainsi que les paramètres Wwise d'AudioLink directement.

Vous pouvez également acheminer la sortie vers un Sound Submix dans les paramètres Wwise d'AudioLink. Le Sound Submix peut capturer la plupart des sorties audio dans Unreal. Cependant, certains plug-ins, comme Text-to-speech, ne peuvent pas être utilisés directement pour cela.

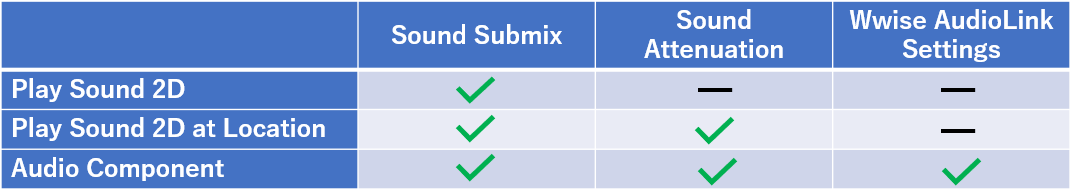

Le tableau suivant résume brièvement ces informations.

Préparation d'un nouveau projet

Intégration et création d'un projet

Veuillez vous référer à l'article précédent et suivre les étapes jusqu'au chapitre « Créer un projet » inclus.

Audio Link - Configuration

(Note : Si vous n'entendez aucun son après avoir effectué ces réglages, essayez de redémarrer Unreal Engine).

Paramètres du projet Wwise

Commençons par l'outil de création Wwise :

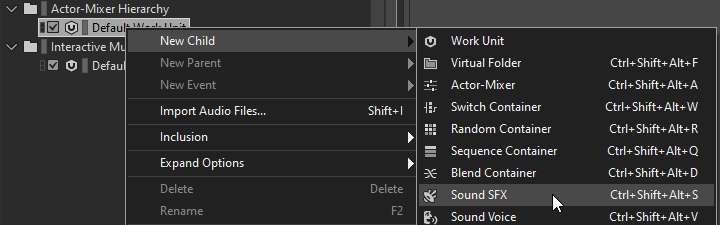

- Créez un object Sound SFX. Appelons-le « AudioInput ».

- Choisissez « Audio Input » comme Source.

![]()

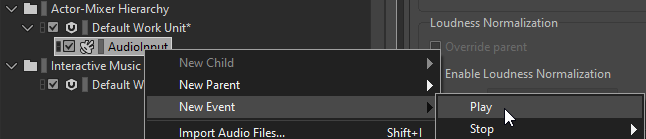

- Créez un Event pour jouer ce SFX.

Voilà pour les paramètres d'entrée audio du côté de Wwise.

Configuration de l'intégration Unreal

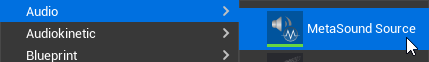

Passons maintenant à l'éditeur Unreal :

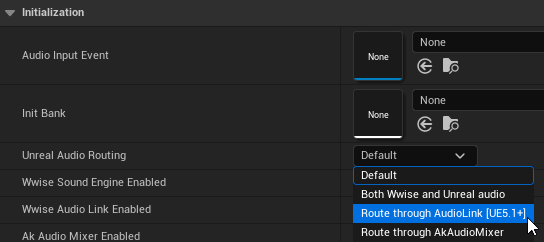

- Edit - Project Settings... – Wwise – Integration Settings – Initialization - Réglez le paramètre de routage audio (« Unreal Audio Routing ») sur « Route through AudioLink [UE5.1+] ». Ensuite, il vous sera demandé de redémarrer Unreal.

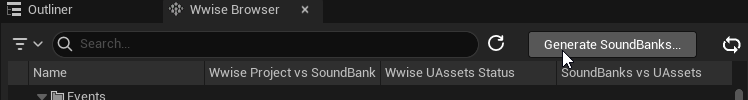

- Cliquez sur le bouton Generate SoundBanks... et suivez la boîte de dialogue Generate SoundBanks suivante pour générer une SoundBank contenant les Events de l'objet « Play_AudioInput » tout juste créé.

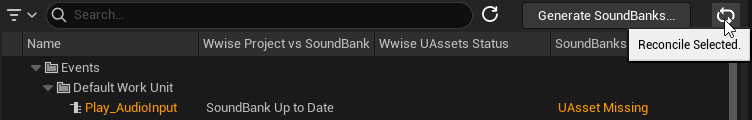

- Appuyez sur le bouton Reconcile.

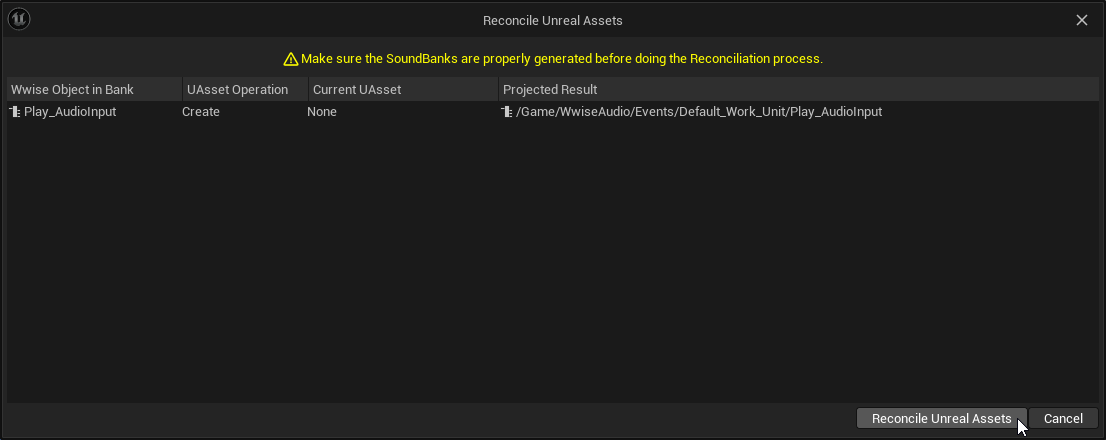

- Dans la boîte de dialogue Reconcile Unreal Assets, cliquez sur le bouton Reconcile Unreal Assets pour générer un UAsset. (Il est possible de générer des UAssets de plusieurs autres façons).

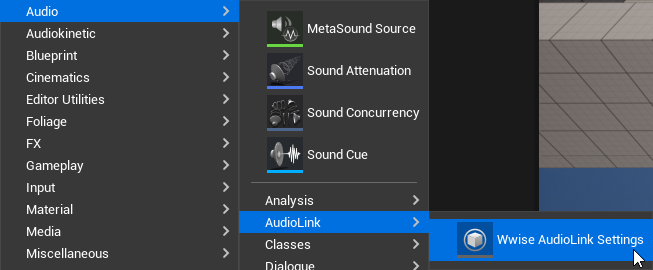

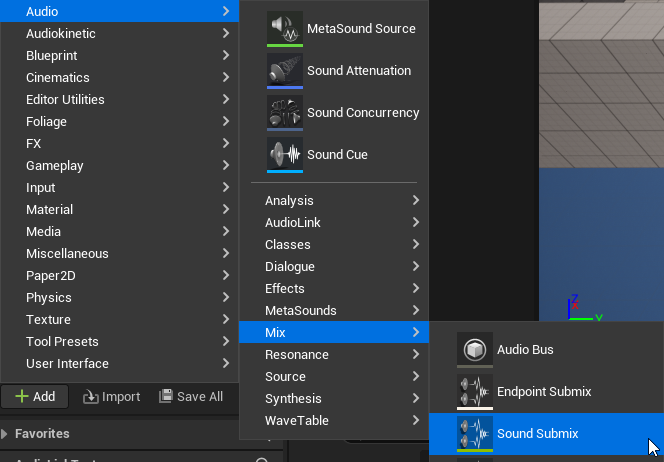

- A partir du bouton Add dans la fenêtre Content Browser, créez un objet Audio - AudioLink - Wwise AudioLink Settings.

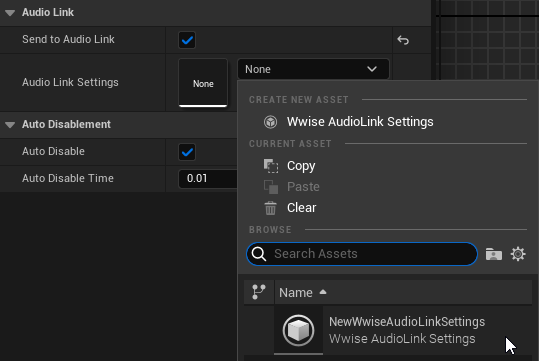

- Modifiez le fichier « NewWwiseAudioLinkSettings » ainsi généré et assignez l'élément Play_Audio Input (AkAudioEvent asset) créé ci-dessus dans le champ « AudioLink – Start Event ».

Maintenant que nous sommes prêts à faire jouer du son depuis la sortie AudioLink vers Wwise, nous avons besoin de configurer la sortie audio d'Unreal Engine pour l'acheminer vers AudioLink.

Paramètres Unreal (Optionnel)

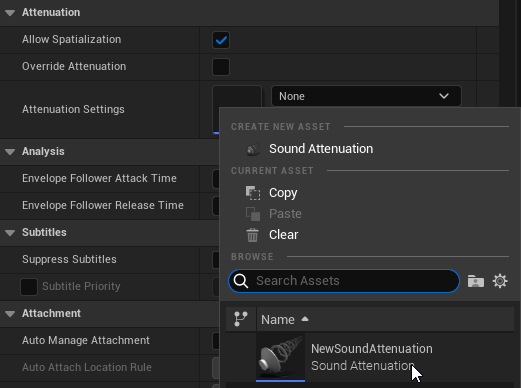

Paramètres de Sound Attenuation

Ce paramètre peut être utilisé pour les méthodes de lecture audio vous permettant de spécifier une Sound Attenuation, telles que « PlaySound2D at Location » ou en utilisant un Audio Component.

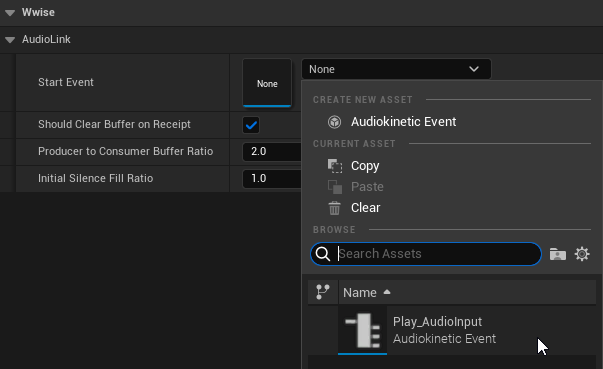

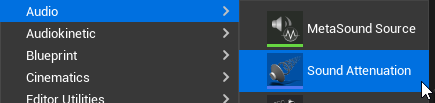

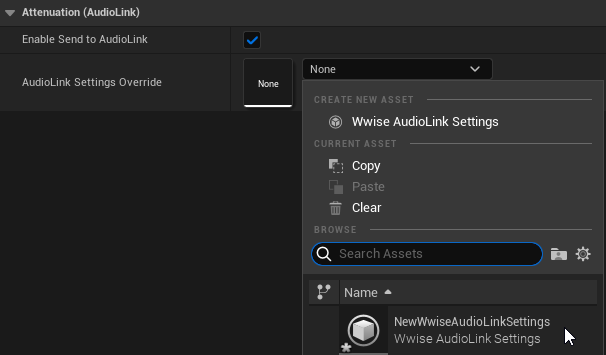

1. Créez un objet Audio – Sound Attenuation à partir du bouton Add depuis le Content Browser.

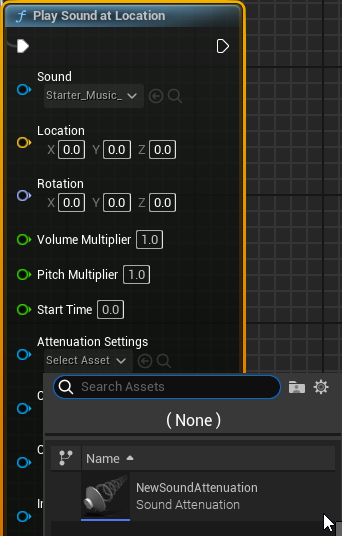

2. Modifiez le « NewSoundAttenuation » ainsi généré et assignez l'objet « NewWwiseAudioLinkSettings » précédemment créé dans le champ Attenuation (AudioLink) – AudioLink Settings Override. De plus, si vous n'avez pas besoin d'atténuation, décochez la case Enabled des différents menus « Attenuation » autres qu'AudioLink

Paramètres de Sound Submix

Créez cette configuration si vous souhaitez émettre du son sur AudioLink à l'aide d'un Sound Submix.

L'atténuation, comme PlaySound2D, mais notez qu'elle doit toujours être activée.

1. À partir du bouton Add depuis le Content Browser, créez un objet Audio – Mix – Sound Submix.

2. Modifiez l'objet « NewSoundSubmix » ainsi généré, activez l'option Send to AudioLink dans le menu « Audio Link », et choisissez Wwise dans le champ « Audio Link Settings ». Spécifiez les paramètres d'AudioLink.

C'est tout pour la configuration. Si vous ne voulez pas l'utiliser, vous pouvez le désactiver en décochant Send to Audio Link.

AudioLink - Jouer un son

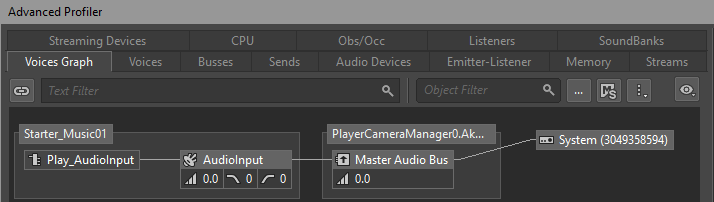

Lors de la lecture d'un son, une fois les paramètres de Sound Attenuation ou de Wwise AudioLink spécifiés, l'entrée audio n'apparaîtra dans le Voice Graph que pendant la lecture.

Si un Sound Submix est activé, il devient difficile de comprendre ce qui se passe lorsque des paramètres Sound Attenuation / Wwise AudioLink sont spécifiés, nous recommandons donc de ne pas utiliser de Sound Submix lors de la vérification de ces opérations.

Lors de la spécification d'une Sound Attenuation (module Blueprint)

Pour définir l'atténuation du son lors de la lecture d'un son à partir d'un module de Blueprint :

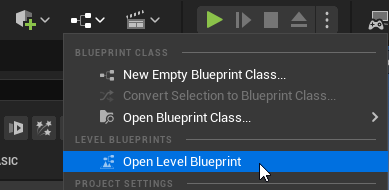

1. Cliquez sur Open Level Blueprint à partir du menu, comme ci-dessous.

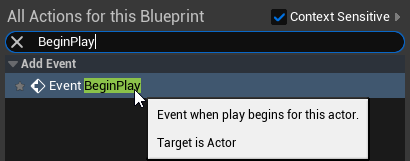

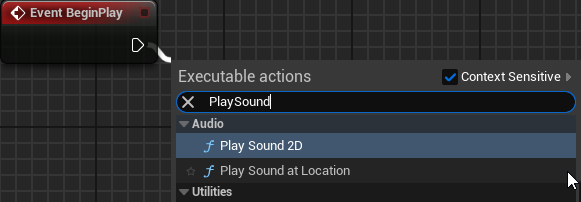

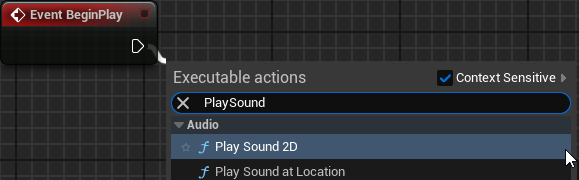

2. Faites un clic droit dans le Blueprint et créez un événement « BeginPlay ».

3. Dessinez un connecteur à partir de l'événement « BeginPlay » et créez un module « Play Sound at Location ».

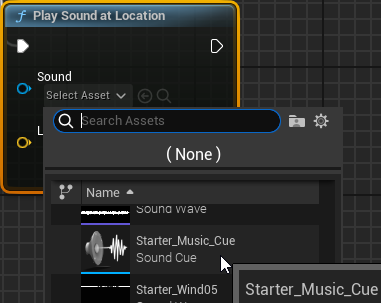

4. Choisissez le son Starter_Music_Cue.

5. Choisissez NewSoundAttenuation dans l'option Attenuation Settings.

Sauvegardez le Blueprint dans cet état et exécutez le fichier à partir de l'éditeur, vous devriez être en mesure de voir dans le Wwise Profiler que le son « Starter_Music_Cue » joue via l'entrée « Play_AudioInput » (les vu-mètres fonctionneront, mais vous ne serez pas en mesure de voir ce qui joue dans Wwise).

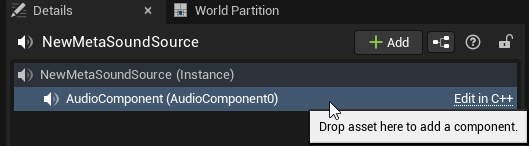

Lors de la spécification d'une Sound Attenuation (Audio Component)

Essayons maintenant avec MetaSounds.

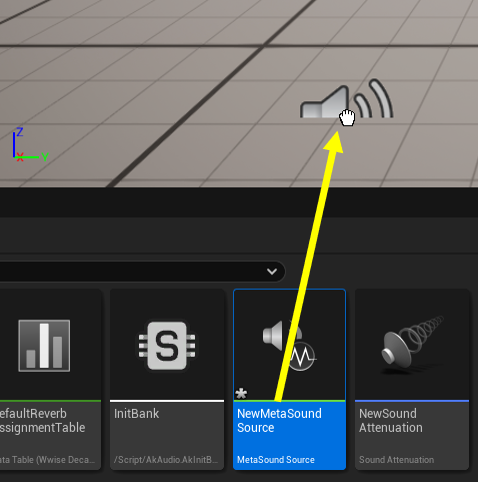

1. Créez un objet Audio – MetaSound Source à partir du bouton Add depuis le Content Browser.

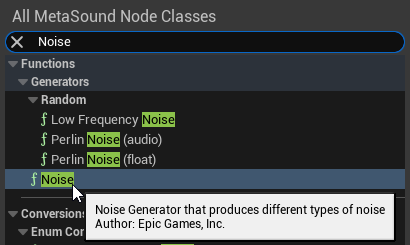

2. Double-cliquez sur la source « NewMetaSound » ainsi générée, puis faites un clic droit sur l'écran qui apparaît afin de créer un module de bruit « Noise ».

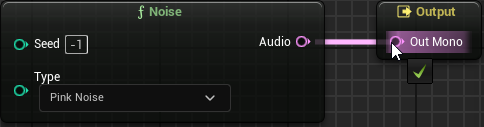

3. Connectez la sortie « Audio » à Out Mono.

4. Faites un glisser-déposer sur l’objet « NewMetaSound Source » depuis le Content Browser vers la fenêtre Viewport.

5. Cliquez sur l'objet placé dans la fenêtre de viewport et sélectionnez AudioComponent dans l'onglet Détails.

6. Choisissez NewSoundAttenuation dans l'option « Attenuation Settings ».

Si vous lancez le jeu dans cette configuration, vous serez en mesure d'entendre le bruit rose généré par MetaSounds via AudioLink.

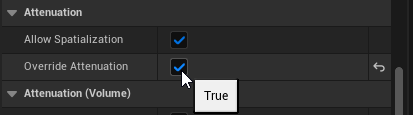

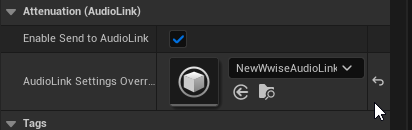

Lors de la spécification des paramètres Wwise d'AudioLink

Essayons une configuration utilisant la source « NewMetaSound » configurée ci-dessus.

1. Dans l'Audio Component, ouvrez Attenuation et activez Override Attenuation.

2. Dans Attenuation (AudioLink) - AudioLink Settings Override, choisissez les paramètres Wwise d'AudioLink.

Dans ce cas, au lieu de référencer la Sound Attenuation, vous pouvez utiliser directement les paramètres Wwise d'AudioLink.

Sound Submix

Utilisons la fonction PlaySound2D et confirmons qu'elle peut être jouée via AudioLink sans avoir à régler de paramètre Sound Attenuation, etc.

1. Dessinez un connecteur à partir de l'événement « BeginPlay » du Level Blueprint et créez un module Play Sound 2D .

2. Dans le champ Sound, choisissez Collapse_Cue.

Veuillez noter que la fonction « Play Sound 2D » ne permet pas de régler de Sound Attenuation, etc.

Si vous compilez le BluePrint et l'exécutez dans cette configuration, vous devriez entendre le son « Collapse_Cue » qui a été assigné.

Même si le Sound Submix est désactivé, vous entendrez toujours le son, mais comme il ne passe pas par Wwise, les vu-mètres de Wwise ne bougeront pas. À l'inverse, s'il est activé, les vu-mètres de Wwise bougeront.

Conclusion

L'utilisation d'AudioLink pour acheminer du son à partir d'Unreal Audio ouvre la porte à des techniques et outils créatifs qui peuvent travailler de concert avec Wwise afin d'obtenir la meilleure représentation possible de votre expérience audio interactive. C'est une façon d'aider au prototypage de systèmes, d'accélérer le développement de feedbacks audiovisuels profondément synchronisés, et de tirer avantage de tout le potentiel disponible en utilisant à la fois Unreal Audio et Wwise. Nous aimerions continuer à fournir des explications faciles à comprendre sur des fonctionnalités qui marchent de manière stable, alors si vous avez des demandes d'explications supplémentaires sur ces fonctionnalités, n'hésitez pas à nous en faire part !

Commentaires